Mussten Sie schon einmal schnell und einfach große Datenmengen von Websites erfassen? Hier kommt Web Scraping ins Spiel!

Web Scraping ist eine Methode, mit der innerhalb weniger Minuten automatisch große Mengen an Informationen von Websites gesammelt werden.

Anstatt Stunden damit zu verbringen, Daten manuell zu kopieren und einzufügen, erledigen Web-Scraping-Tools die ganze Arbeit für Sie.

Unternehmen weltweit nutzen Web Scraping, um wichtige Daten für Marktforschung, Preisvergleiche, Kundeneinblicke und sogar Lead-Generierung zu sammeln. Es hilft, Zeit zu sparen, die Effizienz zu steigern und intelligentere Entscheidungen zu treffen.

Lassen Sie uns herausfinden, was Web Scraping ist, wie es funktioniert und wie Ihr Unternehmen davon profitieren kann. Lassen Sie uns gemeinsam herausfinden, wie Web Scraping Ihr Unternehmenswachstum fördern kann!

Was ist Web Scraping?

Web Scraping ist kein neues Verfahren. Diese Praxis gibt es bereits seit vielen Jahren.

Allerdings hat die Popularität erst in den letzten Jahren zugenommen, was zur Entwicklung von Software geführt hat, die den Web-Harvesting-Prozess automatisiert und ihn schneller und effizienter macht.

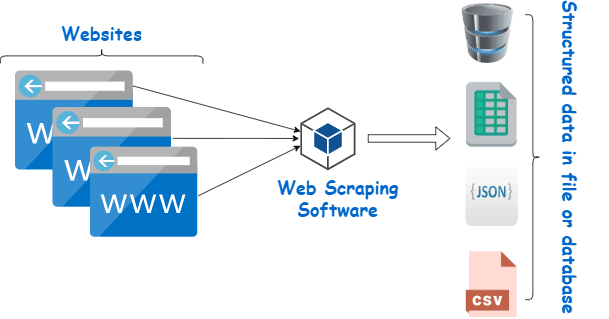

Beim Web Scraping handelt es sich um den Vorgang, spezifische öffentliche Daten von mehreren Websites zu sammeln und in einem einzigen Format zusammenzustellen, sodass eine Auswertung oder Nutzung auf verschiedene Weise möglich ist.

Im Wesentlichen legen Sie in Ihrem Web-Harvesting-Tool Parameter fest, um die Art der Informationen anzugeben, die Sie erfassen möchten, beispielsweise Produktpreise.

Anschließend führen Sie die Software aus und das Programm durchsucht automatisch das Internet, sammelt die angeforderten öffentlichen Daten und analysiert sie, um sie lesbar zu machen.

Nach dem Parsen werden die Informationen in das von Ihnen gewünschte Format, beispielsweise eine Tabelle, zusammengestellt.

Was ist ethisches Web Scraping?

Es ist wichtig, Daten auf ethische Weise zu scrapen. Leider haben einige Personen dieses Tool missbraucht.

Manche Personen versuchen, Informationen abzugreifen, die sie nicht abgreifen sollten, wie etwa persönliche Daten oder Inhalte hinter Sicherheitsmaßnahmen, wie etwa Anmeldungen und mehr.

Es gibt auch Scraper, die mehrere Scraping-Anfragen an dieselbe Website senden, was die Website verlangsamt und zu Abstürzen führen kann.

Um die Vorteile dieses Tools nutzen zu können, müssen wir sicherstellen, dass es ethisch korrekt eingesetzt wird. Dazu gehört, dass Sie nur öffentliche Daten scrapen und niemals versuchen, persönliche Informationen oder Inhalte zu sammeln, die durch Logins, Passwörter oder andere Maßnahmen geschützt sind.

Es ist außerdem wichtig, die zu scrapende Website nicht mit zahlreichen Anfragen zu überlasten. Staffeln Sie stattdessen Ihre Anfragen oder legen Sie das Scraping auf eine Zeit fest, in der der Website-Verkehr gering ist.

Stellen Sie abschließend sicher, dass Sie die gesammelten Daten respektvoll verwenden und niemals die Daten anderer als Ihre eigenen ausgeben.

Wie funktionieren Web Scraper?

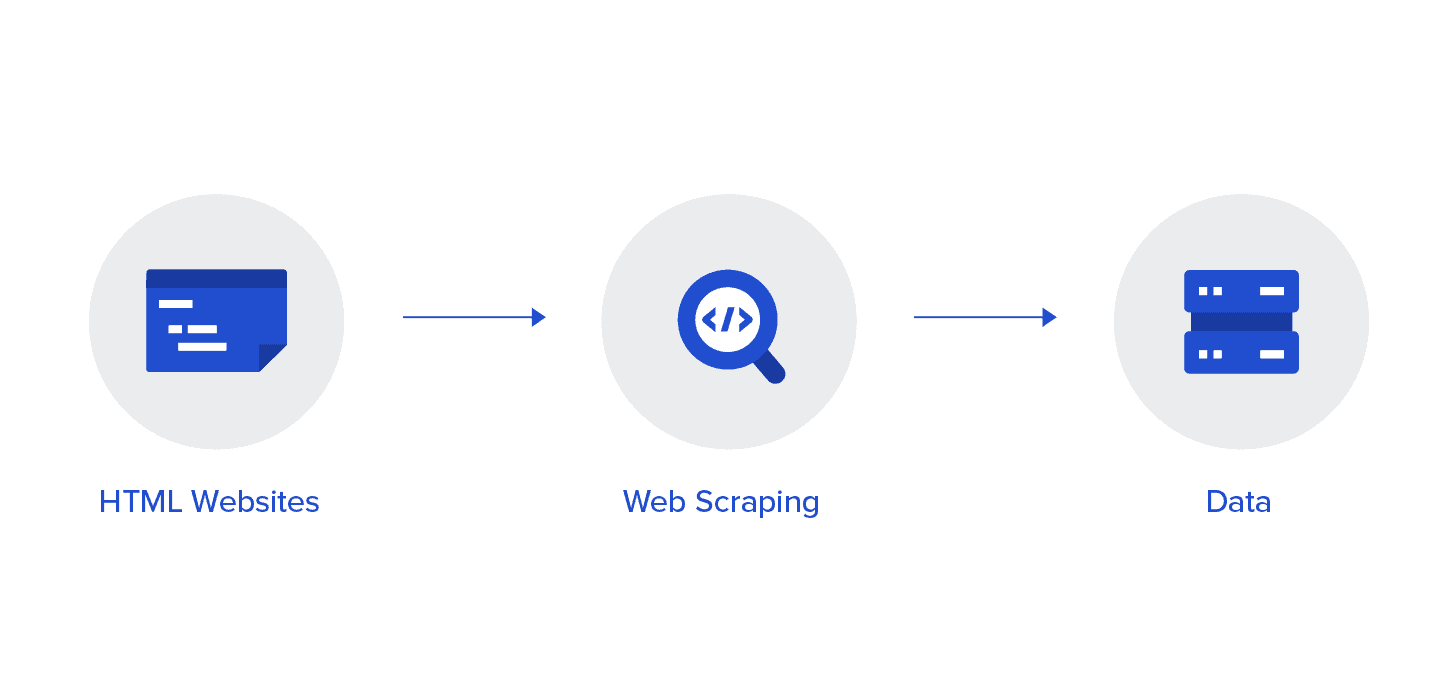

Web Scraper sind Tools oder Software, die zum automatischen Sammeln von Daten von Websites verwendet werden. So funktionieren sie im Allgemeinen:

- Anfragen senden: Der Scraper sendet eine HTTP-Anfrage an den Server der Website, um auf deren Inhalt zuzugreifen, ähnlich wie ein Browser eine Seite lädt.

- HTML-Inhalt herunterladen: Sobald der Server antwortet, lädt der Scraper den HTML-Code der Website herunter, der alle Inhalte wie Text, Bilder und Links enthält.

- HTML analysieren: Der Scraper analysiert den HTML-Code mithilfe einer bestimmten Analysemethode (wie BeautifulSoup oder lxml für Python), um die relevanten Daten zu extrahieren (z. B. Produktpreise, Benutzerbewertungen usw.).

- Datenextraktion: Der Scraper identifiziert die gewünschten Datenpunkte anhand von HTML-Tags, CSS-Klassen oder XPaths und extrahiert diese Informationen.

- Daten speichern: Die extrahierten Daten werden dann zur einfachen Analyse und Verwendung in einem strukturierten Format wie einer CSV-Datei, Datenbank oder JSON gespeichert.

- Griffnavigation: Einige Web Scraper können die Paginierung oder dynamische Inhalte (z. B. mit JavaScript geladene Inhalte) verarbeiten, indem sie Klicks simulieren oder zusätzliche Anfragen stellen, um Daten von mehreren Seiten zu sammeln.

Web Scraping wird häufig für Marktforschung, Preisvergleiche, Data Mining und SEO-Analysen verwendet und ermöglicht es Unternehmen und Einzelpersonen, schnell große Mengen an Informationen zu sammeln.

Muss ich beim Web Scraping einen Proxy verwenden?

Ja, Sie sollten beim Sammeln von Daten einen Residential Proxy verwenden.

Es ist zwar möglich, a Rechenzentrums-Proxyist ein Residential Proxy beim Web Scraping deutlich zuverlässiger. Das liegt daran, Wohnvertreter sind mit realen Geräten mit IPs und einem ISP verknüpft.

Daher sehen alle Anfragen von diesem Proxy wie ein echter Webbesucher aus und werden nicht gesperrt, sodass Sie mehr Daten sammeln und sicherstellen können, dass die gesammelten Daten korrekt sind.

Quick Links

- Beste eBay-Proxys

- Beste Scrapebox-Proxys

- Beste Tripadvisor-Proxys

- Beste Twitter Proxies

- Beste gemeinsam genutzte Proxys

- Beste Kanada-Proxys

Abschließende Gedanken: Was ist Web Scraping 2026?

Web Scraping ist ein leistungsstarkes Tool, das Unternehmen dabei hilft, schnell und effizient wertvolle Daten zu sammeln.

Ganz gleich, ob Sie Einblicke in die Konkurrenz, Preisverfolgung, Markttrends oder Kundendaten benötigen – Web Scraping vereinfacht den Vorgang.

Anstatt stundenlang manuell Informationen zu sammeln, erledigt die Automatisierung diese Aufgabe in wenigen Minuten. Das bedeutet bessere Entscheidungen, intelligentere Strategien und schnelleres Unternehmenswachstum.

Mit den richtigen Tools und Methoden kann Ihnen Web Scraping in der heutigen datengetriebenen Welt einen entscheidenden Vorteil verschaffen. Nutzen Sie Web Scraping noch heute, um sich einen Wettbewerbsvorteil zu verschaffen und neue Geschäftschancen zu erschließen!