Pernahkah Anda perlu mengumpulkan banyak data dari situs web dengan cepat dan mudah? Di sinilah web scraping berperan!

Pengikisan web adalah metode yang digunakan untuk secara otomatis mengumpulkan sejumlah besar informasi dari situs web dalam hitungan menit.

Alih-alih menghabiskan waktu berjam-jam menyalin dan menempel data secara manual, alat pengikisan web melakukan semua pekerjaan untuk Anda.

Bisnis di seluruh dunia memanfaatkan web scraping untuk mengumpulkan data penting untuk riset pasar, perbandingan harga, wawasan pelanggan, dan bahkan perolehan prospek. Hal ini membantu menghemat waktu, meningkatkan efisiensi, dan membuat keputusan yang lebih cerdas.

Mari kita cari tahu apa itu web scraping, cara kerjanya, dan bagaimana web scraping dapat menguntungkan bisnis Anda secara sederhana. Mari kita jelajahi bagaimana web scraping dapat membantu bisnis Anda berkembang!

Apa itu Pengikisan Web?

Pengikisan web bukanlah proses baru. Praktik ini telah ada selama bertahun-tahun.

Akan tetapi, baru dalam beberapa tahun terakhir ini popularitasnya meningkat, yang mendorong terciptanya perangkat lunak yang mengotomatiskan proses pengumpulan web dan menjadikannya lebih cepat dan lebih efisien.

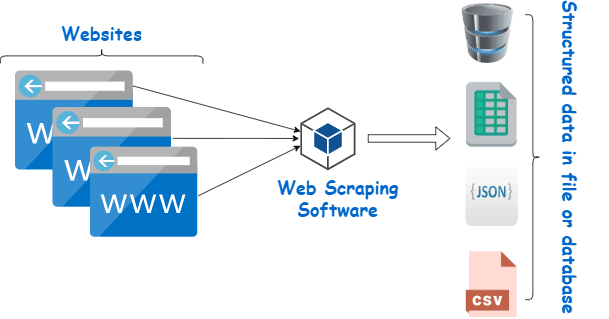

Pengikisan web adalah proses pengumpulan data publik tertentu dari beberapa situs web dan menyusunnya ke dalam satu format, yang memungkinkan evaluasi atau pemanfaatan dalam berbagai cara.

Pada dasarnya, Anda akan menetapkan parameter dalam alat pengumpulan web Anda untuk menentukan jenis informasi yang ingin Anda kumpulkan, seperti harga produk.

Kemudian, Anda menjalankan perangkat lunak tersebut, dan program tersebut akan secara otomatis mencari di internet, mengumpulkan data publik yang diminta, dan menguraikannya agar dapat dibaca.

Setelah diurai, informasi akan dikompilasi ke dalam format yang Anda minta, seperti lembar kerja.

Apa itu Scraping Web yang Etis?

Sangat penting untuk mengumpulkan data secara etis. Sayangnya, beberapa orang telah menyalahgunakan alat ini.

Beberapa orang mencoba mengikis informasi yang tidak seharusnya mereka dapatkan, seperti detail pribadi atau konten di balik langkah-langkah keamanan, seperti login dan lainnya.

Ada pula scraper yang mengirim beberapa permintaan scraping ke situs web yang sama, yang memperlambat situs web dan dapat mengakibatkan crash.

Untuk menikmati manfaat yang ditawarkan alat ini, kita harus memastikan penggunaannya secara etis. Salah satu tujuannya adalah memastikan Anda hanya mengumpulkan data publik dan tidak pernah mencoba mengumpulkan informasi pribadi atau konten yang dilindungi oleh login, kata sandi, atau tindakan lainnya.

Penting juga untuk tidak membanjiri situs web yang sedang Anda scraping dengan banyak permintaan. Alih-alih, atur permintaan Anda secara bertahap atau atur scraping pada waktu ketika lalu lintas situs web sedang lambat.

Terakhir, pastikan Anda menggunakan data yang dikumpulkan dengan penuh rasa hormat dan jangan pernah mengakui data orang lain sebagai data Anda sendiri.

Bagaimana Cara Kerja Web Scraper?

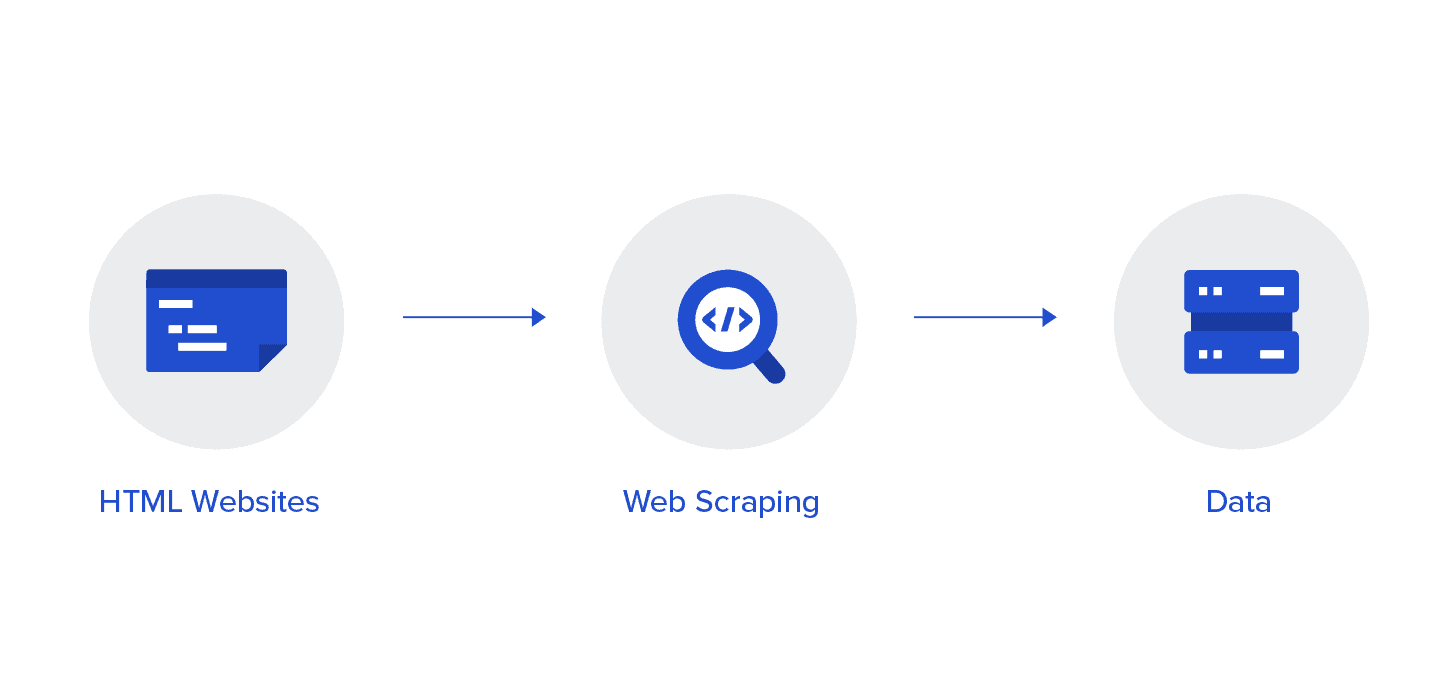

Pengikis web adalah alat atau perangkat lunak yang digunakan untuk mengumpulkan data dari situs web secara otomatis. Berikut cara kerjanya secara umum:

- Kirim Permintaan: Scraper mengirimkan permintaan HTTP ke server situs web untuk mengakses kontennya, mirip dengan cara browser memuat halaman.

- Unduh Konten HTML: Setelah server merespons, scraper mengunduh kode HTML situs web, yang berisi semua konten, seperti teks, gambar, dan tautan.

- Parsing HTML: Scraper mengurai kode HTML menggunakan metode penguraian tertentu (seperti BeautifulSoup atau lxml untuk Python) untuk mengekstrak data yang relevan (misalnya, harga produk, ulasan pengguna, dll.).

- Ekstraksi Data: Scraper mengidentifikasi titik data yang diinginkan berdasarkan tag HTML, kelas CSS, atau XPath dan mengekstrak informasi ini.

- Menyimpan data: Data yang diekstraksi kemudian disimpan dalam format terstruktur seperti file CSV, database, atau JSON untuk memudahkan analisis dan penggunaan.

- Menangani Navigasi: Beberapa web scraper dapat menangani pagination atau konten dinamis (misalnya, konten yang dimuat JavaScript) dengan mensimulasikan klik atau membuat permintaan tambahan untuk mengumpulkan data dari beberapa halaman.

Pengikisan web banyak digunakan untuk riset pasar, perbandingan harga, penambangan data, dan analisis SEO, yang memungkinkan bisnis dan individu mengumpulkan sejumlah besar informasi dengan cepat.

Apakah Saya Perlu Menggunakan Proxy Saat Web Scraping?

Ya, Anda harus menggunakan proksi perumahan saat mengumpulkan data.

Meskipun memungkinkan untuk menggunakan proksi pusat data, proxy residensial jauh lebih andal dalam hal pengikisan web. Hal ini karena proxy perumahan terhubung ke perangkat nyata dengan IP dan ISP.

Dengan demikian, setiap permintaan dari proxy ini akan terlihat seperti pengunjung web yang sebenarnya dan tidak akan dilarang, sehingga Anda dapat mengumpulkan lebih banyak data dan memastikan bahwa data yang dikumpulkan akurat.

Tautan

- Proxy eBay Terbaik

- Proxy scrapebox terbaik

- Proxy Tripadvisor Terbaik

- Proxy Twitter Terbaik

- Proxy Bersama Terbaik

- Proxy Kanada Terbaik

Pemikiran Akhir: Apa itu Web Scraping 2026?

Pengikisan web adalah alat hebat yang membantu bisnis mengumpulkan data berharga dengan cepat dan efisien.

Apakah Anda memerlukan wawasan pesaing, pelacakan harga, tren pasar, atau data pelanggan, pengikisan web mempermudah prosesnya.

Alih-alih menghabiskan waktu berjam-jam mengumpulkan informasi secara manual, otomatisasi dapat menyelesaikan pekerjaan dalam hitungan menit. Ini berarti pengambilan keputusan yang lebih baik, penerapan strategi yang lebih cerdas, dan pertumbuhan bisnis yang lebih cepat.

Dengan alat dan metode yang tepat, web scraping dapat memberi Anda keuntungan besar di dunia yang digerakkan oleh data saat ini. Mulailah menggunakan web scraping hari ini untuk mendapatkan keunggulan kompetitif dan membuka peluang baru bagi bisnis Anda!