Hai mai avuto bisogno di raccogliere molti dati da siti web in modo rapido e semplice? È qui che entra in gioco il web scraping!

Il web scraping è un metodo utilizzato per raccogliere automaticamente grandi quantità di informazioni dai siti web in pochi minuti.

Invece di passare ore a copiare e incollare manualmente i dati, gli strumenti di web scraping fanno tutto il lavoro per te.

Le aziende di tutto il mondo utilizzano il web scraping per raccogliere dati cruciali per ricerche di mercato, confronti di prezzi, analisi dei clienti e persino lead generation. Aiuta a risparmiare tempo, aumentare l'efficienza e prendere decisioni più consapevoli.

Scopriamo cos'è il web scraping, come funziona e come può apportare benefici alla tua attività in termini semplici. Scopriamo come il web scraping può aiutare la tua attività a crescere!

Che cos'è il web scraping?

Il web scraping non è un processo nuovo. La pratica esiste da molti anni.

Tuttavia, è solo negli ultimi anni che la sua popolarità è cresciuta, portando alla creazione di software che automatizzano il processo di raccolta dati dal web, rendendolo più rapido ed efficiente.

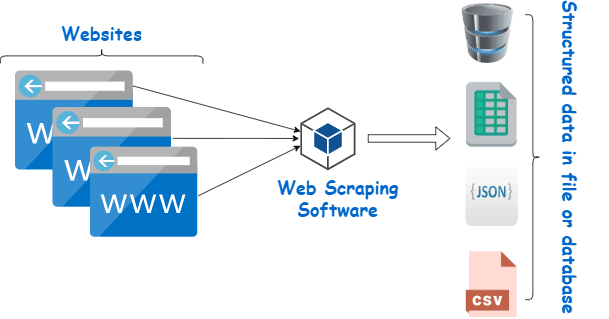

Il web scraping è il processo di raccolta di dati pubblici specifici da più siti web e di compilazione degli stessi in un unico formato, consentendone la valutazione o l'utilizzo in vari modi.

In sostanza, imposterai i parametri nel tuo strumento di raccolta dati web per specificare il tipo di informazioni che vuoi raccogliere, ad esempio i prezzi dei prodotti.

Dopodiché, si esegue il software e il programma cercherà automaticamente su Internet, raccoglierà i dati pubblici richiesti e li analizzerà per renderli leggibili.

Dopo l'analisi, le informazioni verranno compilate nel formato richiesto, ad esempio un foglio di calcolo.

Che cos'è il web scraping etico?

È fondamentale estrarre i dati in modo etico. Purtroppo, alcuni hanno fatto un uso improprio di questo strumento.

Alcune persone cercano di recuperare informazioni che non dovrebbero, come dati personali o contenuti dietro le misure di sicurezza, come accessi e altro ancora.

Ci sono anche degli scraper che inviano più richieste di scraping allo stesso sito web, il che rallenta il sito e può causare crash.

Per sfruttare i vantaggi offerti da questo strumento, dobbiamo assicurarci che venga utilizzato in modo etico. A tal fine, è fondamentale assicurarsi di raccogliere solo dati pubblici e di non cercare mai di raccogliere informazioni personali o contenuti protetti da credenziali di accesso, password o altre misure.

È inoltre importante non sovraccaricare il sito web che si sta analizzando con numerose richieste. Piuttosto, è consigliabile scaglionare le richieste o impostare lo scraping in un momento in cui il traffico del sito web è basso.

Infine, assicurati di utilizzare i dati raccolti in modo rispettoso e di non spacciare mai i dati di qualcun altro per tuoi.

Come funzionano i web scraper?

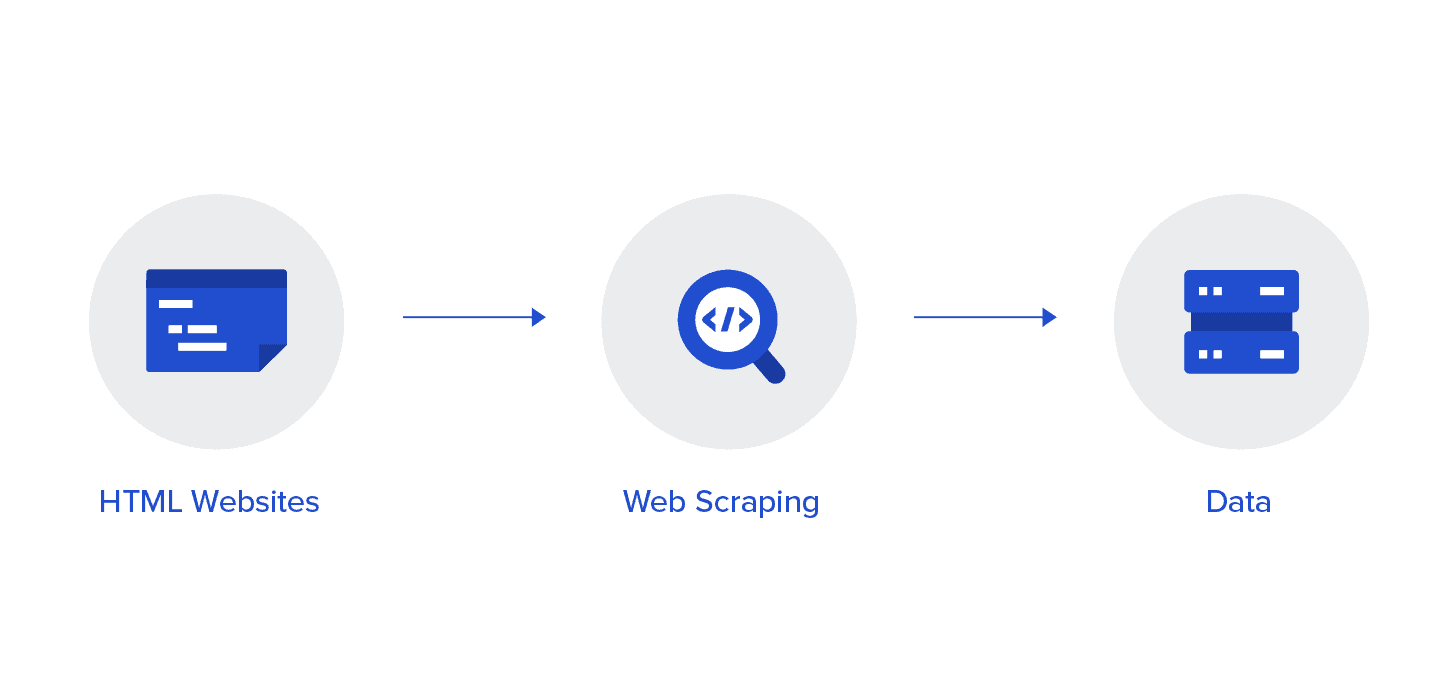

I web scraper sono strumenti o software utilizzati per raccogliere automaticamente dati dai siti web. Ecco come funzionano in genere:

- Inviare richieste: Lo scraper invia una richiesta HTTP al server del sito web per accedervi, in modo simile a come un browser carica una pagina.

- Scarica il contenuto HTML: Una volta che il server risponde, lo scraper scarica il codice HTML del sito web, che contiene tutti i contenuti, come testo, immagini e link.

- Analizza HTML: Lo scraper analizza il codice HTML utilizzando uno specifico metodo di analisi (come BeautifulSoup o lxml per Python) per estrarre i dati rilevanti (ad esempio, prezzi dei prodotti, recensioni degli utenti, ecc.).

- Estrazione dei dati: Lo scraper identifica i punti dati desiderati in base a tag HTML, classi CSS o XPath ed estrae queste informazioni.

- Immagazzina dati: I dati estratti vengono quindi archiviati in un formato strutturato, ad esempio un file CSV, un database o un JSON, per facilitarne l'analisi e l'utilizzo.

- Gestisci la navigazione: Alcuni web scraper possono gestire la paginazione o i contenuti dinamici (ad esempio, contenuti caricati tramite JavaScript) simulando clic o effettuando richieste aggiuntive per raccogliere dati da più pagine.

Il web scraping è ampiamente utilizzato per ricerche di mercato, confronti di prezzi, data mining e analisi SEO, consentendo ad aziende e privati di raccogliere rapidamente grandi quantità di informazioni.

È necessario utilizzare un proxy durante lo scraping del Web?

Sì, dovresti utilizzare un proxy residenziale quando raccogli dati.

Sebbene sia possibile utilizzare a proxy del data center, un proxy residenziale è molto più affidabile quando si tratta di web scraping. Questo perché proxy residenziali sono collegati a dispositivi reali con IP e un ISP.

Pertanto, qualsiasi richiesta da questo proxy sembrerà un vero visitatore web e non verrà bandita, quindi puoi raccogliere più dati e assicurarti che i dati raccolti siano accurati.

Collegamenti rapidi

- I migliori proxy eBay

- I migliori proxy Scrapebox

- I migliori proxy di Tripadvisor

- I migliori proxy di Twitter

- I migliori proxy condivisi

- I migliori proxy canadesi

Considerazioni finali: cos'è il Web Scraping 2026?

Il web scraping è uno strumento potente che aiuta le aziende a raccogliere dati preziosi in modo rapido ed efficiente.

Che tu abbia bisogno di informazioni sulla concorrenza, di monitoraggio dei prezzi, di tendenze di mercato o di dati sui clienti, il web scraping semplifica il processo.

Invece di dedicare ore alla raccolta manuale di informazioni, l'automazione risolve il problema in pochi minuti. Questo significa prendere decisioni migliori, implementare strategie più intelligenti e raggiungere una crescita aziendale più rapida.

Con gli strumenti e i metodi giusti, il web scraping può darti un grande vantaggio nel mondo odierno basato sui dati. Inizia a usare il web scraping oggi stesso per ottenere un vantaggio competitivo e sbloccare nuove opportunità per la tua attività!