แหล่งข้อมูลที่ใหญ่ที่สุดในโลกน่าจะพบได้บนอินเทอร์เน็ต การรวบรวมและวิเคราะห์ข้อมูลจากเว็บไซต์มีการใช้งานที่มีศักยภาพมากมายในหลากหลายสาขา รวมถึงวิทยาศาสตร์ข้อมูล ข่าวกรององค์กร และการรายงานเชิงสืบสวน

นักวิทยาศาสตร์ข้อมูลกำลังมองหาข้อมูลและข้อมูลใหม่ๆ อยู่เสมอเพื่อแก้ไขและวิเคราะห์ การขูดข้อมูลทางอินเทอร์เน็ตเพื่อหาข้อมูลเฉพาะเป็นวิธีหนึ่งที่ได้รับความนิยมมากที่สุดในการดำเนินการดังกล่าว

คุณพร้อมสำหรับประสบการณ์การขูดเว็บครั้งแรกแล้วหรือยัง? แต่ก่อนอื่น คุณต้องเข้าใจว่าแท้จริงแล้วการขูดเว็บคืออะไรและพื้นฐานบางประการ จากนั้นเราจะพูดถึงเทคนิคการขูดเว็บที่ดีที่สุด

Web Scraping คืออะไร

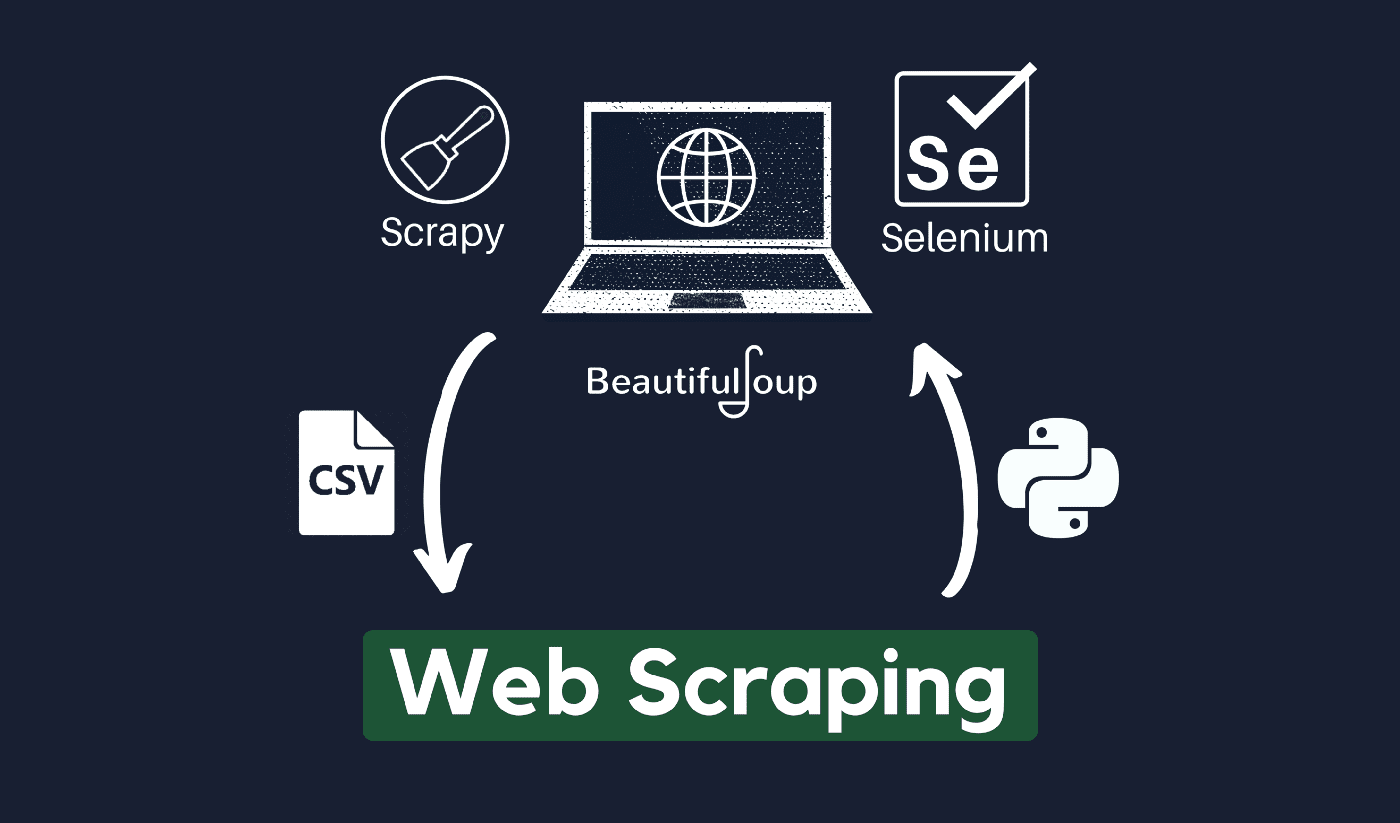

เทคนิคการรวบรวมและประมวลผลข้อมูลดิบจากเว็บเรียกว่า web scraping และชุมชน Python ได้พัฒนาเครื่องมือ web scraping ที่ค่อนข้างทรงพลัง ก ไปป์ไลน์ข้อมูล ใช้ในการประมวลผลและจัดเก็บข้อมูลนี้ในลักษณะที่มีโครงสร้าง

การขูดเว็บเป็นวิธีปฏิบัติทั่วไปในปัจจุบันซึ่งมีแอปพลิเคชันมากมาย:

- ธุรกิจการตลาดและการขายสามารถรวบรวมข้อมูลที่เกี่ยวข้องกับลูกค้าเป้าหมายได้โดยใช้การขูดเว็บ

- บริษัทอสังหาริมทรัพย์สามารถรับข้อมูลเกี่ยวกับการพัฒนาใหม่ อสังหาริมทรัพย์เพื่อขาย ฯลฯ ได้โดยใช้ web scraping

- เว็บไซต์เปรียบเทียบราคา เช่น Trivago มักใช้ Web Scraping เพื่อรับข้อมูลผลิตภัณฑ์และราคาจากเว็บไซต์อีคอมเมิร์ซต่างๆ

คุณสามารถขูดเว็บได้หลากหลาย การเขียนโปรแกรมภาษาและภาษาการเขียนโปรแกรมแต่ละภาษาก็มีไลบรารี่ที่หลากหลายที่สามารถช่วยให้คุณบรรลุผลสำเร็จในสิ่งเดียวกันได้ หนึ่งในโปรแกรมยอดนิยม เชื่อถือได้ และถูกกฎหมายที่ใช้สำหรับการขูดเว็บอย่างมีประสิทธิภาพคือ Python

เกี่ยวกับ Python

Python เป็นภาษาที่ได้รับความนิยมมากที่สุดสำหรับการขูดที่พัฒนาและเปิดตัวในปี 1991 ภาษาการเขียนโปรแกรมนี้มักใช้ในการสร้างเว็บไซต์ เขียนโค้ด สร้างซอฟต์แวร์ สร้างสคริปต์ระบบ และอื่นๆ โปรแกรมนี้ถือเป็นรากฐานสำคัญของภาคส่วนออนไลน์และมีการใช้กันอย่างแพร่หลายในเชิงพาณิชย์ทั่วโลก

เว็บแอปพลิเคชันสามารถพัฒนาบนเซิร์ฟเวอร์โดยใช้ Python สามารถใช้ร่วมกับแอปพลิเคชันเพื่อสร้างกระบวนการและเชื่อมโยงกับระบบฐานข้อมูลได้ ไฟล์ยังสามารถอ่านและเปลี่ยนแปลงได้

นอกจากนี้ยังสามารถใช้เพื่อจัดการข้อมูลขนาดใหญ่ ดำเนินการทางคณิตศาสตร์ที่ซับซ้อน เร่งกระบวนการต้นแบบ หรือสร้างซอฟต์แวร์ที่พร้อมสำหรับการผลิต

คุณจะใช้ Python สำหรับการขูดเว็บได้อย่างไร?

คุณจะต้องดำเนินการสามขั้นตอนเพื่อคัดลอกและดึงข้อมูลใดๆ จากอินเทอร์เน็ต: รับ HTML รับแผนผัง HTML และสุดท้ายแยกข้อมูลจากแผนผัง

เป็นไปได้ที่จะดึงรหัส HTML จากไซต์ที่กำหนดโดยใช้ไลบรารีคำขอ ต้นไม้ HTML จะถูกแยกวิเคราะห์และแยกออกโดยใช้ สวยซุปและข้อมูลอาจถูกจัดระเบียบโดยใช้ Python เท่านั้น

ขอแนะนำให้ตรวจสอบนโยบายการใช้งานที่ยอมรับได้ของเว็บไซต์เป้าหมายของคุณเสมอ เพื่อดูว่าการเข้าถึงเว็บไซต์โดยใช้เครื่องมืออัตโนมัติถือเป็นการละเมิดเงื่อนไขการใช้งานหรือไม่ ก่อนที่จะใช้ความสามารถพิเศษ Python ของคุณในการขูดเว็บ

การขูดเว็บทำงานอย่างไร

โดยทั่วไปแล้วสไปเดอร์จะใช้ในออนไลน์ การขูด กระบวนการ. พวกเขาดึงเอกสาร HTML จากเว็บไซต์ที่เกี่ยวข้อง แยกเนื้อหาที่จำเป็นตามตรรกะทางธุรกิจ จากนั้นจัดเก็บไว้ในรูปแบบที่กำหนด

เว็บไซต์นี้ทำหน้าที่เป็นแนวทางในการสร้างสแครปเปอร์ที่ปรับขนาดได้สูง

เฟรมเวิร์กและวิธีการของ Python รวมกับข้อมูลโค้ดบางส่วนสามารถใช้เพื่อดึงข้อมูลด้วยวิธีตรงไปตรงมาหลายวิธี มีคำแนะนำหลายข้อที่อาจช่วยให้คุณนำสิ่งเดียวกันนี้ไปปฏิบัติได้

การคัดลอกหน้าเดียวนั้นเป็นเรื่องง่าย แต่การจัดการโค้ดสไปเดอร์ การรวบรวมข้อมูล และการบำรุงรักษาคลังข้อมูลนั้นทำได้ยากเมื่อทำการคัดลอกหลายล้านหน้า เพื่อให้การขูดง่ายและแม่นยำ เราจะตรวจสอบปัญหาเหล่านี้และวิธีแก้ไข

ลิงค์ด่วน:

**เคล็ดลับเพิ่มเติม: ใช้ IP แบบหมุนเวียนและบริการพร็อกซี

เมื่อคุณได้ภาพที่ชัดเจนแล้ว Web Scraping ช่วยให้คุณสามารถรวบรวมข้อมูลจากเว็บโดยใช้ชุดคำสั่งการเขียนโปรแกรม แต่อย่างที่คุณต้องทราบ กิจกรรมการขูดเว็บของคุณสามารถตรวจสอบได้ผ่านที่อยู่ IP ของคุณ

นี่จะไม่เป็นปัญหามากนักหากข้อมูลที่คุณคัดลอกมาจากสาธารณสมบัติ แต่ถ้าคุณขูดข้อมูลส่วนตัวจากไซต์สื่อพิเศษ คุณอาจประสบปัญหาหากที่อยู่ IP ของคุณถูกติดตาม

ดังนั้น โดยพื้นฐานแล้ว เพื่อป้องกันไม่ให้ Spider ของคุณถูกขึ้นบัญชีดำ ขอแนะนำให้ใช้บริการพร็อกซีและเปลี่ยนที่อยู่ IP เสมอ

เราไม่สนับสนุนให้คุณใช้การขูดเว็บเพื่อรวบรวมข้อมูลที่ผิดกฎหมายหรือส่วนตัวหรือหลงระเริงกับกิจกรรมสปายแวร์ที่เป็นอันตราย

แต่หากคุณกำลังรวบรวมข้อมูลที่อาจเป็นส่วนตัว ขอแนะนำให้ปิดบังหรือหมุนเวียนข้อมูลของคุณ ที่อยู่ IP หรือใช้พร็อกซีเซิร์ฟเวอร์เพื่อหลีกเลี่ยงการติดตาม

คุณอาจชอบอ่าน:

การขูดเว็บถูกกฎหมายหรือไม่?

อย่างเป็นทางการไม่มีการระบุไว้ในบรรทัดฐานและแนวปฏิบัติทางอินเทอร์เน็ตว่าการขูดเว็บเป็นสิ่งผิดกฎหมาย เพื่อความเป็นธรรม การขูดเว็บเป็นสิ่งที่ถูกกฎหมาย หากคุณทำงานกับข้อมูลสาธารณะ

ในช่วงปลายเดือนมกราคม 2020 มีการประกาศว่าอนุญาตให้คัดลอกข้อมูลที่เปิดเผยต่อสาธารณะเพื่อวัตถุประสงค์ที่ไม่ใช่เชิงพาณิชย์ได้โดยสิ้นเชิง

ข้อมูลที่สาธารณชนทั่วไปสามารถเข้าถึงได้โดยเสรีคือข้อมูลที่ทุกคนออนไลน์สามารถเข้าถึงได้โดยไม่ต้องใช้รหัสผ่านหรือการรับรองความถูกต้องอื่นๆ ดังนั้นข้อมูลที่เปิดเผยต่อสาธารณะรวมถึงข้อมูลที่อาจพบได้ในวิกิพีเดีย โซเชียลมีเดีย หรือ การค้นหาของ Google ผล.

อย่างไรก็ตาม บางเว็บไซต์ห้ามไม่ให้ผู้ใช้ขูดข้อมูลของตนอย่างชัดเจนด้วยการขูดเว็บ การขูดข้อมูลจากโซเชียลมีเดียบางครั้งถือว่าผิดกฎหมาย

เหตุผลก็คือบางส่วนไม่สามารถเข้าถึงได้โดยบุคคลทั่วไป เช่น เมื่อผู้ใช้ทำให้ข้อมูลของตนเป็นแบบส่วนตัว ในกรณีนี้ ห้ามคัดลอกข้อมูลนี้ การคัดลอกข้อมูลจากเว็บไซต์โดยไม่ได้รับความยินยอมจากเจ้าของก็ถือเป็นอันตรายเช่นกัน

รับประโยชน์สูงสุดจากเว็บผ่าน Web Scraping!

การรวบรวมและวิเคราะห์ข้อมูลจากเว็บไซต์มีการใช้งานที่มีศักยภาพมากมายในหลากหลายสาขา รวมถึงวิทยาศาสตร์ข้อมูล ข่าวกรององค์กร และการรายงานเชิงสืบสวน

ความสามารถพื้นฐานประการหนึ่งที่นักวิทยาศาสตร์ข้อมูลต้องการคือการขูดเว็บ

โปรดทราบว่าไม่ใช่ทุกคนที่ต้องการให้คุณเข้าถึงเว็บเซิร์ฟเวอร์เพื่อรับข้อมูล ก่อนที่จะเริ่มขูดเว็บไซต์ ตรวจสอบให้แน่ใจว่าคุณได้อ่านเงื่อนไขการใช้งานแล้ว นอกจากนี้ ควรคำนึงถึงเวลาในการสืบค้นเว็บของคุณเพื่อหลีกเลี่ยงไม่ให้เซิร์ฟเวอร์ล้นหลาม

ข้อมูลน่าสนใจเพิ่มเติม