Web Scraper

- Browserbasiertes Tool

- Einfach zu bedienende Oberfläche

- Exportiert Daten in CSV/JSON

- Ideal für Anfänger

ParseHub

- Visuelle Datenextraktion

- Bewältigt komplexe Websites

- Cloud-basierte Plattform

- Unterstützt mehrere Formate

Scrapy

- Python-basiertes Framework

- Flexibel anpassbar

- Open Source und kostenlos

- Ideal für großflächiges Schaben

Apify ist eine beliebte Plattform für Web Scraping und Automatisierung, aber es handelt sich nicht um eine Einheitslösung.

Abhängig von Ihren Zielen – ob Datenextraktion, Social Media Scraping oder Automatisierung im großen Maßstab – gibt es möglicherweise andere Tools, die besser zu Ihren spezifischen Anforderungen, Ihrem Budget oder Ihrem technischen Know-how passen.

Glücklicherweise gibt es viele hervorragende Alternativen mit einzigartigen Funktionen, von No-Code-Optionen für Anfänger bis hin zu fortgeschrittenen Frameworks für Entwickler.

Lassen Sie uns die besten Apify-Alternativen erkunden und ihre Funktionen, Vor- und Nachteile aufschlüsseln, damit Sie die für Ihr Projekt perfekte Alternative auswählen können. Tauchen Sie ein!

Die 10 besten Apify-Alternativen 2026: Die besten Optionen zum Erkunden

Nachfolgend habe ich die 10 besten Apify-Alternativen aufgeführt:

1. Mixnode

Mixnode ist eine dynamische Plattform, die zum Extrahieren und Analysieren von Daten aus dem Internet mit beeindruckender Geschwindigkeit, Flexibilität und enormer Skalierbarkeit entwickelt wurde.

Es bietet eine breite Palette von Funktionen, die eine effiziente Datenextraktion und umfassende Analyse aus verschiedenen Online-Quellen ermöglichen.

Im Kern zeichnet sich Mixnode durch seine Fähigkeit aus, Daten schnell aus dem Internet abrufen. Diese Plattform gewährleistet mit ihrer leistungsstarken Infrastruktur eine schnelle Extraktion der gewünschten Informationen und minimiert so den Zeit- und Arbeitsaufwand für die Datenerfassung.

Unabhängig davon, ob Sie spezifische Datenpunkte oder umfassende Datensätze benötigen, sorgt die Agilität von Mixnode für einen nahtlosen und effizienten Datenabrufprozess.

Flexibilität ist eine weitere große Stärke von Mixnode. Es bietet ein vielseitiges Toolkit, mit dem Benutzer ihre Datenextraktionsanforderungen entsprechend ihren spezifischen Anforderungen anpassen können.

Von strukturierten Daten bis hin zu unstrukturierten Inhalten bietet Mixnode die notwendigen Tools zum Extrahieren und Transformieren von Informationen aus verschiedenen Webquellen, sodass Benutzer wertvolle Erkenntnisse gewinnen und datengesteuerte Entscheidungen treffen können.

2. Web Scraper

Web Scraper ist ein hochgelobtes Web-Scraping-Erweiterung, weithin als das beliebteste Werkzeug seiner Art anerkannt.

Mit Web Scraper können Sie dank der benutzerfreundlichen Oberfläche und des nahtlosen Einrichtungsprozesses innerhalb von Minuten Scraping-Aktivitäten starten.

Darüber hinaus ermöglicht die Cloud Scraper-Funktion die Automatisierung von Aufgaben, sodass weder Software-Downloads noch Programmierkenntnisse erforderlich sind.

Als erste Wahl für Web Scraping bietet Web Scraper eine Reihe von Vorteilen für Benutzer, die wertvolle Daten von Websites extrahieren möchten.

Seine Popularität beruht auf seiner Einfachheit und Zugänglichkeit. Egal, ob Sie Anfänger oder erfahrener Benutzer sind, die intuitive Benutzeroberfläche von Web Scraper ermöglicht Ihnen einen schnellen Einstieg in Ihre Scraping-Aktivitäten.

Sie müssen keine wertvolle Zeit und Mühe damit verschwenden, sich in komplexer Software zurechtzufinden oder komplizierte Programmiersprachen zu entschlüsseln.

Die Hauptfunktion von Web Scraper, der Cloud Scraper, bringt die Automatisierung auf die nächste Ebene. Durch die Nutzung dieser leistungsstarken Funktionalität können Sie Ihre Scraping-Aufgaben rationalisieren und beschleunigen.

Mit dem Cloud Scraper müssen Sie keine Software auf Ihrem Gerät installieren und geben so wertvollen Speicherplatz frei. Darüber hinaus können Sie sich von den Feinheiten der Codierung verabschieden.

Web Scraper macht eine manuelle Codierung überflüssig und ermöglicht es Benutzern, Aufgaben ohne technisches Fachwissen zu automatisieren.

3. Import.io

Import.io ist eine hochmoderne webbasierte Plattform, die Benutzern die Möglichkeit gibt, die Leistungsfähigkeit maschinenlesbarer Webdaten zu nutzen.

Mit der umfassenden Tool-Suite von Import.io können Sie mühelos APIs erstellen oder ganze Websites mit beispielloser Geschwindigkeit und Effizienz crawlen, ganz ohne Programmieraufwand.

Im Kern revolutioniert Import.io die Art und Weise, wie Benutzer mit Webdaten interagieren. Herkömmliche Methoden der Datenextraktion und -analyse erfordern oft zeitaufwändige manuelle Prozesse und komplizierte Codierung.

Import.io rationalisiert jedoch diesen gesamten Arbeitsablauf und ermöglicht es Benutzern, in einem Bruchteil der Zeit wertvolle Daten aus dem Web zu extrahieren und zu nutzen.

Eine der herausragenden Funktionen von Import.io ist die Möglichkeit, APIs ohne Codierung zu erstellen. APIs oder Application Programming Interfaces tragen maßgeblich dazu bei, eine nahtlose Datenintegration und Automatisierung zu ermöglichen.

Mit Import.io können Sie Webdaten mühelos in APIs umwandeln und so einen reibungslosen und effizienten Datenaustausch zwischen verschiedenen Systemen und Anwendungen ermöglichen.

Dies eröffnet Entwicklern, Datenwissenschaftlern und Unternehmen, die Webdaten für ihre spezifischen Anforderungen nutzen möchten, eine Welt voller Möglichkeiten.

4. UiPath

UiPath ist ein leistungsstarkes Automatisierungstool, das umfassende Funktionen zur Automatisierung von Web- und Desktopanwendungen bietet.

Es bietet eine kostenlose, voll funktionsfähige und hoch erweiterbare Plattform und ist somit die ideale Wahl für Einzelpersonen, kleine professionelle Teams, Bildungseinrichtungen und Schulungszwecke.

Im Kern ermöglicht UiPath den Benutzern die Automatisierung verschiedener Aufgaben und Prozesse, Steigerung der Produktivität und Effizienz.

Ganz gleich, ob es darum geht, sich wiederholende Aktionen in einer Webanwendung zu automatisieren oder Arbeitsabläufe in einer Desktop-Umgebung zu optimieren, die vielseitigen Funktionen von UiPath decken ein breites Spektrum an Automatisierungsanforderungen ab.

Einer der Hauptvorteile von UiPath ist die benutzerfreundliche Oberfläche, die den Automatisierungsprozess vereinfacht. Die Plattform bietet einen visuellen Workflow-Designer, der es Benutzern ermöglicht, Automatisierungs-Workflows erstellen ohne dass umfangreiche Programmierkenntnisse erforderlich sind.

Durch einen Drag-and-Drop-Ansatz können Benutzer Automatisierungssequenzen einfach zusammenstellen, indem sie Aktivitäten wie Datenextraktion, Eingabeautomatisierung und Entscheidungslogik kombinieren.

5. ParseHub

ParseHub ist ein leistungsstarkes Web-Scraping-Tool, das speziell zum Navigieren und Extrahieren von Daten aus der modernen Weblandschaft entwickelt wurde. Eine der herausragenden Funktionen von ParseHub ist die Fähigkeit, Daten von praktisch überall im Web zu extrahieren.

Ganz gleich, ob es sich um einseitige Anwendungen, mehrseitige Anwendungen oder eine andere moderne Webtechnologie handelt, ParseHub ist für die Herausforderung gerüstet.

Es navigiert mühelos durch dynamische Webseiten, AJAX-gesteuerte Websites und andere fortschrittliche Webtechnologien und stellt sicher, dass keine Daten außer Reichweite bleiben.

Die Elemente bei ParseHub werden häufig in der modernen Webentwicklung verwendet, um die Benutzererfahrung zu verbessern und Inhalte dynamisch zu laden.

Allerdings können sie herkömmliche Schabewerkzeuge vor Herausforderungen stellen. Die fortschrittlichen Algorithmen und die robuste Infrastruktur von ParseHub bewältigen diese Komplexität nahtlos und gewährleisten eine genaue und umfassende Datenextraktion.

ParseHub bietet eine benutzerfreundliche Oberfläche und ein visuelles Point-and-Click-System zum Erstellen von Scraping-Projekten. Sie können die benötigten Daten einfach definieren, indem Sie die Elemente auf der Webseite auswählen, z. B. Text, Bilder, Links oder Tabellen.

Dieser intuitive Ansatz macht komplexe Codierung oder manuelle Navigation durch HTML-Strukturen überflüssig. Mit ParseHub können Sie Scraping-Projekte schnell erstellen und ändern und so wertvolle Zeit und Mühe sparen.

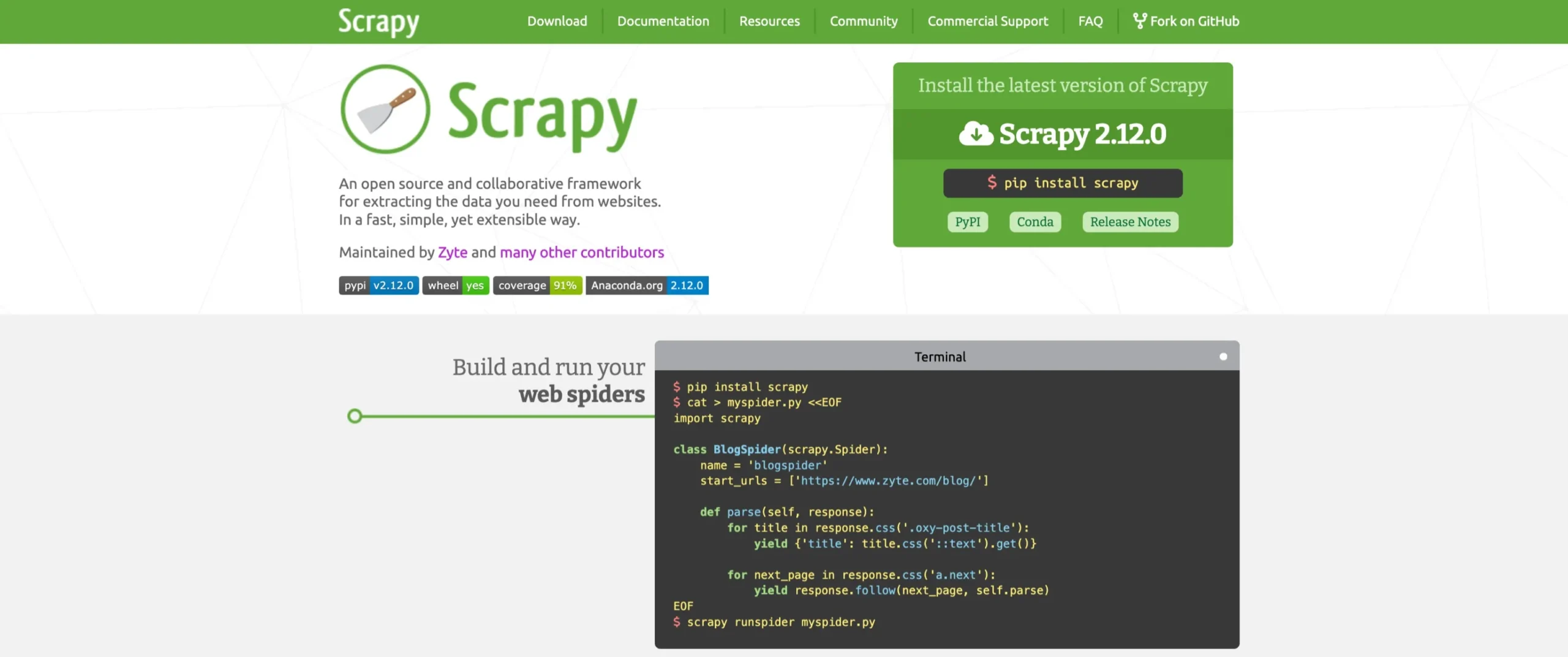

6. Scrapy

Scrapy ist ein Python-basiertes Web-Crawling-Framework, das für seine Vielseitigkeit und seinen Open-Source-Charakter bekannt ist.

Scrapy wurde ursprünglich für das Web-Scraping entwickelt und hat sich zu einem leistungsstarken Tool zum Extrahieren von Daten mithilfe von APIs und als universeller Web-Crawler entwickelt.

Scrapy wurde von Zyte, früher bekannt als Scrapinghub, entwickelt und gepflegt und genießt im Bereich Web Scraping großes Vertrauen.

Im Kern bietet Scrapy einen umfassenden Satz an Tools und Bibliotheken für das Web-Crawling und die Datenextraktion. Es bietet eine flexible und modulare Architektur, die es Entwicklern ermöglicht, ihre Scraping-Projekte an spezifische Anforderungen anzupassen.

Mit seiner Python-Basis nutzt Scrapy das reichhaltige Ökosystem und die umfangreichen Bibliotheken der Programmiersprache Python, was es zu einer beliebten Wahl bei Entwicklern macht.

Die Vielseitigkeit von Scrapy geht über das Web-Scraping hinaus. Das Framework lässt sich nahtlos in APIs integrieren und ermöglicht es Benutzern, Daten aus einer Vielzahl von Quellen zu extrahieren.

Durch die Nutzung von APIs kann Scrapy strukturierte Daten abrufen von Social Media Plattformen, Webdienste und verschiedene Online-Datenbanken.

Diese Flexibilität macht Scrapy zur idealen Wahl für Anwendungen, die über das herkömmliche Web Scraping hinausgehen.

7. UI.Vision RPA

UI.Vision RPA ist ein Open-Source-Tool zur Aufgaben- und Testautomatisierung, das über traditionelle Funktionen hinausgeht. Als Browser-Erweiterung ermöglicht es nicht nur Web-Automatisierung bietet aber auch Desktop-Automatisierungsfunktionen.

Einer der Hauptvorteile von UI.Vision RPA ist seine Vielseitigkeit. Herkömmliche Automatisierungstools konzentrieren sich oft ausschließlich auf die Webautomatisierung und lassen andere Aspekte der Aufgabenautomatisierung unberührt.

UI.Vision RPA überwindet diese Barriere jedoch, indem es die Möglichkeit bietet, Aufgaben sowohl im Web als auch auf dem Desktop zu automatisieren.

Ganz gleich, ob es um die Interaktion mit Webanwendungen, die Automatisierung von Formularübermittlungen, das Extrahieren von Daten aus Bildschirmen oder die Durchführung komplexer RPA-Workflows geht – UI.Vision RPA ist für die unterschiedlichsten Automatisierungsanforderungen gerüstet.

Die Art der Browsererweiterung von UI.Vision RPA bietet Komfort und Benutzerfreundlichkeit. Es lässt sich nahtlos in gängige Webbrowser integrieren, sodass Benutzer das volle Potenzial der Erweiterung direkt in ihrer Browserumgebung nutzen können.

Dadurch entfällt die Notwendigkeit separater Softwareinstallationen und es steht eine benutzerfreundliche Oberfläche zum Erstellen und Verwalten von Automatisierungsaufgaben zur Verfügung.

8. Oktoparese

Octoparse ist ein vielseitiges Web-Scraping-Tool, das sich an fortgeschrittene Benutzer richtet und eine Drag-and-Drop-Oberfläche bietet.

Es unterstützt sowohl lokales als auch Cloud-basiertes Scraping und ist daher flexibel für verschiedene Anwendungsfälle. Octoparse kann CAPTCHA verarbeiten und Anti-Scraping-Mechanismen, die für moderne Websites unerlässlich sind.

Obwohl es benutzerfreundlich ist, kann das Einrichten von Workflows für erweiterte Aufgaben eine Herausforderung darstellen. Auch die Preisstruktur kann für Kleinanwender teuer sein.

9. PhantomBuster

PhantomBuster ist ein leistungsstarkes Tool zur Automatisierung von Aufgaben wie der Extraktion von Social-Media-Daten, der Lead-Generierung und der Workflow-Automatisierung.

Es bietet vorgefertigte Vorlagen für Plattformen wie LinkedIn, Twitter und Instagram und ist daher auch für Nicht-Programmierer benutzerfreundlich.

Durch die Integration mit Tools wie Zapier können Benutzer PhantomBuster in größere Workflows einbinden. Allerdings ist es stärker auf soziale Daten ausgerichtet und für allgemeines Web Scraping weniger effektiv.

Darüber hinaus können die Abonnementpreise bei Skalierungsprojekten teuer werden.

10 WebHarvy

WebHarvy ist ein Point-and-Click-Web-Scraper für den Desktop, der keine Programmierkenntnisse erfordert.

Es ist ideal für Benutzer, die schnell und ohne komplexe Konfigurationen Daten von statischen oder dynamischen Websites extrahieren möchten.

WebHarvy unterstützt erweiterte Funktionen wie Regex-Muster, Datenformatierung und Planung und ist daher vielseitig für kleine und mittelgroße Projekte geeignet.

Es ist jedoch auf die Verwendung auf dem Desktop beschränkt und bietet kein Cloud-basiertes Scraping, was bei großen oder kollaborativen Projekten ein Nachteil sein kann.

Links:

- Webshare-Alternativen: Mein Top-Favorit

- Entfesseln Sie die Kraft des Web Crawlers

- Die besten Web-Scraping-Proxys

- IPRoyal-Rezension

- Proxy-Hub-Überprüfung

Fazit: Die Apify Alternativen 2026

Die Wahl der besten Apify-Alternative hängt von Ihren Anforderungen, Ihrem Budget und Ihren technischen Fähigkeiten ab. Wenn Sie Entwickler sind und eine vollständige Anpassung wünschen, ist Scrapy ein hervorragendes Open-Source-Framework.

Für Anfänger oder Nicht-Programmierer bieten ParseHub und Octoparse benutzerfreundliche Schnittstellen ohne Programmierkenntnisse.

Wenn Ihr Schwerpunkt auf der Automatisierung sozialer Medien und der Lead-Generierung liegt, ist PhantomBuster eine großartige Option. Für schnelles und einfaches desktopbasiertes Scraping ist WebHarvy ideal.

Jedes Tool hat seine Stärken und Schwächen. Bewerten Sie daher Größe, Komplexität und Budget Ihres Projekts, um die perfekte Lösung zu finden. Es gibt für jeden eine Option, vom Gelegenheitsnutzer bis zum fortgeschrittenen Entwickler.