Grattoir Web

- Outil basé sur un navigateur

- Interface très simple d’utilisation

- Exporte les données vers CSV/JSON

- Idéal pour les débutants

ParseHub

- Extraction de données visuelles

- Gère des sites Web complexes

- Plateforme cloud

- Prend en charge plusieurs formats

Scrapy

- Cadre basé sur Python

- hautement personnalisable

- Open source et gratuit

- Idéal pour le grattage à grande échelle

Apify est une plateforme populaire pour le scraping et l'automatisation du Web, mais ce n'est pas une solution universelle.

En fonction de vos objectifs (qu'il s'agisse d'extraction de données, de scraping de médias sociaux ou d'automatisation à grande échelle), il peut exister d'autres outils mieux adaptés à vos besoins spécifiques, à votre budget ou à votre expertise technique.

Heureusement, il existe de nombreuses excellentes alternatives qui offrent des fonctionnalités uniques, des options sans code pour les débutants aux frameworks avancés pour les développeurs.

Explorons les meilleures alternatives à Apify, en analysant leurs fonctionnalités, leurs avantages et leurs inconvénients afin que vous puissiez choisir celle qui convient parfaitement à votre projet. Plongeons-nous dans le vif du sujet !

10 meilleures alternatives à Apify 2026 : les meilleures options à explorer

Ci-dessous, j'ai mentionné les 10 meilleures alternatives à Apify :

1. nœud mixte

Mixnode est une plateforme dynamique conçue pour extraire et analyser des données d'Internet avec une vitesse, une flexibilité et une évolutivité massive impressionnantes.

Il offre une large gamme de fonctionnalités qui permettent une extraction efficace des données et une analyse complète à partir de diverses sources en ligne.

À la base, Mixnode excelle dans sa capacité à récupérer rapidement des données sur le Web. Grâce à son infrastructure performante, cette plateforme assure une extraction rapide des informations souhaitées, minimisant ainsi le temps et les efforts nécessaires à l'acquisition des données.

Que vous ayez besoin de points de données spécifiques ou d'ensembles de données complets, l'agilité de Mixnode garantit un processus de récupération de données transparent et efficace.

La flexibilité est une autre force clé de Mixnode. Il offre une boîte à outils polyvalente qui permet aux utilisateurs d'adapter leurs besoins d'extraction de données en fonction de leurs besoins spécifiques.

Des données structurées au contenu non structuré, Mixnode fournit les outils nécessaires pour extraire et transformer les informations de diverses sources Web, permettant aux utilisateurs d'obtenir des informations précieuses et de prendre des décisions basées sur les données.

2. Grattoir Web

Web Scraper est un outil très apprécié extension de grattage Web, largement reconnu comme l'outil le plus populaire de son genre.

Avec Web Scraper, vous pouvez lancer des activités de scraping en quelques minutes, grâce à son interface conviviale et à son processus de configuration transparent.

De plus, la fonctionnalité Cloud Scraper permet l'automatisation des tâches, éliminant ainsi le besoin de téléchargements de logiciels ou d'expertise en codage.

En tant que choix incontournable pour le scraping Web, Web Scraper offre une multitude d'avantages aux utilisateurs cherchant à extraire des données précieuses de sites Web.

Sa popularité découle de sa simplicité et de son accessibilité. Que vous soyez un débutant ou un utilisateur expérimenté, l'interface intuitive de Web Scraper vous permet de démarrer rapidement vos efforts de grattage.

Vous n'avez pas à consacrer un temps et des efforts précieux à naviguer dans des logiciels complexes ou à déchiffrer des langages de codage complexes.

La fonctionnalité clé de Web Scraper, le Cloud Scraper, fait passer l'automatisation au niveau supérieur. En tirant parti de cette fonctionnalité puissante, vous pouvez rationaliser et accélérer vos tâches de scraping.

Avec le Cloud Scraper, il n'est pas nécessaire d'installer de logiciel sur votre appareil, ce qui libère un espace de stockage précieux. De plus, vous pouvez dire adieu aux subtilités du codage.

Web Scraper élimine le besoin de codage manuel, permettant aux utilisateurs d'automatiser les tâches sans aucune expertise technique.

3. Import.io

Import.io est une plate-forme Web de pointe qui permet aux utilisateurs d'exploiter la puissance des données Web lisibles par machine.

Avec la suite complète d'outils d'Import.io, vous pouvez créer sans effort des API ou explorer des sites Web entiers avec une vitesse et une efficacité inégalées, le tout sans avoir besoin de coder.

À la base, Import.io révolutionne la façon dont les utilisateurs interagissent avec les données Web. Les méthodes traditionnelles d'extraction et d'analyse de données impliquent souvent des processus manuels chronophages et un codage complexe.

Cependant, Import.io rationalise l'ensemble de ce flux de travail, permettant aux utilisateurs d'extraire et d'utiliser des données précieuses du Web en une fraction du temps.

L'une des fonctionnalités les plus remarquables d'Import.io est sa capacité à créer des API sans codage. Les API, ou interfaces de programmation d'applications, sont essentielles pour permettre une intégration et une automatisation transparentes des données.

Avec Import.io, vous pouvez facilement transformer des données Web en API, permettant un échange de données fluide et efficace entre différents systèmes et applications.

Cela ouvre un monde de possibilités pour les développeurs, les scientifiques des données et les entreprises qui cherchent à tirer parti des données Web pour leurs besoins spécifiques.

4. UiPath

UiPath est un puissant outil d'automatisation qui offre un ensemble complet de fonctionnalités pour automatiser les applications Web et de bureau.

Il fournit une plate-forme gratuite, complète et hautement extensible, ce qui en fait un choix idéal pour les particuliers, les petites équipes professionnelles, les établissements d'enseignement et les formations.

À la base, UiPath permet aux utilisateurs d’automatiser diverses tâches et processus, améliorer la productivité et efficacité.

Qu'il s'agisse d'automatiser des actions répétitives dans une application Web ou de rationaliser les flux de travail dans un environnement de bureau, les capacités polyvalentes d'UiPath répondent à un large éventail de besoins d'automatisation.

L'un des principaux avantages d'UiPath est son interface conviviale, qui simplifie le processus d'automatisation. La plateforme propose un concepteur de workflows visuel, permettant aux utilisateurs de créer des flux de travail d'automatisation sans avoir besoin de connaissances approfondies en codage.

Grâce à une approche glisser-déposer, les utilisateurs peuvent facilement assembler des séquences d'automatisation en combinant des activités, telles que l'extraction de données, l'automatisation des entrées et la logique de prise de décision.

5. ParseHub

ParseHub est un puissant outil de grattage Web conçu spécifiquement pour naviguer et extraire des données du paysage Web moderne. L'une des fonctionnalités les plus remarquables de ParseHub est sa capacité à extraire des données de pratiquement n'importe où sur le Web.

Que vous ayez affaire à des applications d'une seule page, à des applications multipages ou à toute autre technologie Web moderne, ParseHub est équipé pour relever le défi.

Il navigue sans effort à travers des pages Web dynamiques, des sites basés sur AJAX et d'autres technologies Web avancées, garantissant qu'aucune donnée ne reste hors de portée.

Les éléments de ParseHub sont couramment utilisés dans le développement Web moderne pour améliorer l'expérience utilisateur et charger dynamiquement le contenu.

Cependant, ils peuvent poser des problèmes aux outils de grattage traditionnels. Les algorithmes avancés et l'infrastructure robuste de ParseHub gèrent de manière transparente ces complexités, garantissant une extraction de données précise et complète.

ParseHub fournit une interface conviviale et un système visuel pointer-cliquer pour créer des projets de scraping. Vous pouvez facilement définir les données dont vous avez besoin en sélectionnant les éléments de la page Web, tels que du texte, des images, des liens ou des tableaux.

Cette approche intuitive élimine le besoin de codage complexe ou de navigation manuelle dans les structures HTML. Avec ParseHub, vous pouvez rapidement créer et modifier des projets de scraping, ce qui vous fait gagner un temps et des efforts précieux.

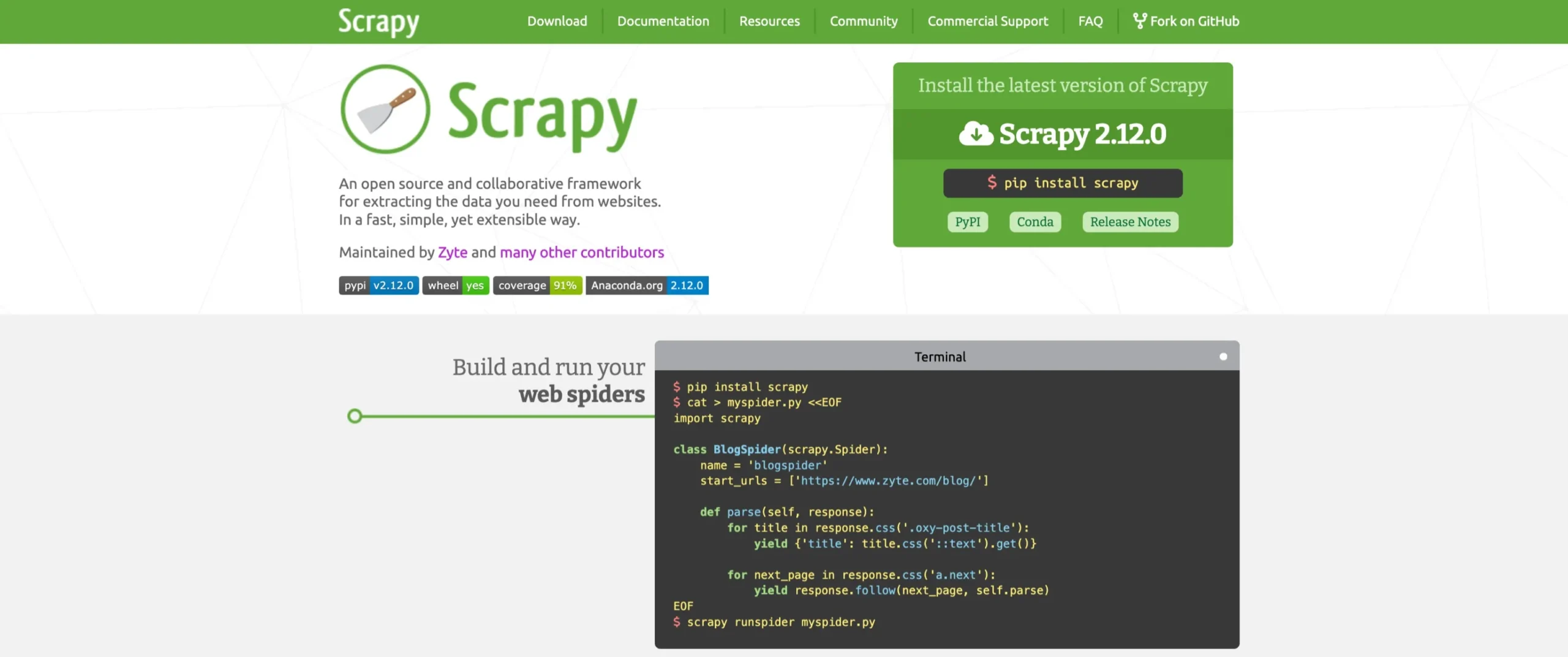

6. Scrapy

Scrapy est un framework d'exploration Web basé sur Python, réputé pour sa polyvalence et sa nature open source.

Conçu à l'origine pour le scraping Web, Scrapy a évolué pour devenir un outil puissant d'extraction de données à l'aide d'API et fonctionnant comme un robot d'exploration Web à usage général.

Développé et maintenu par Zyte, anciennement connu sous le nom de Scrapinghub, Scrapy est largement reconnu dans le domaine du grattage Web.

À la base, Scrapy fournit un ensemble complet d'outils et de bibliothèques pour l'exploration Web et l'extraction de données. Il offre une architecture flexible et modulaire qui permet aux développeurs d'adapter leurs projets de scraping à des exigences spécifiques.

Avec sa fondation Python, Scrapy exploite le riche écosystème et les vastes bibliothèques disponibles dans le langage de programmation Python, ce qui en fait un choix populaire parmi les développeurs.

La polyvalence de Scrapy s'étend au-delà du grattage Web. Le cadre s'intègre de manière transparente aux API, permettant aux utilisateurs d'extraire des données à partir d'un large éventail de sources.

En exploitant les API, Scrapy peut récupérer des données structurées à partir de les réseaux sociaux, plateformes, services Web et diverses bases de données en ligne.

Cette flexibilité fait de Scrapy un choix idéal pour les applications au-delà du scraping Web traditionnel.

7. UI.Vision RPA

UI.Vision RPA est un outil open source d'automatisation des tâches et des tests qui va au-delà des fonctionnalités traditionnelles. En tant qu'extension de navigateur, il permet non seulement automatisation Web mais offre également des fonctionnalités d'automatisation de bureau.

L'un des principaux avantages d'UI.Vision RPA réside dans sa polyvalence. Les outils d'automatisation traditionnels se concentrent souvent uniquement sur l'automatisation web, laissant de côté les autres aspects de l'automatisation des tâches.

Cependant, UI.Vision RPA brise cette barrière en offrant la possibilité d'automatiser les tâches à la fois sur le Web et sur le bureau.

Qu'il s'agisse d'interagir avec des applications Web, d'automatiser la soumission de formulaires, d'extraire des données d'écrans ou d'effectuer des flux de travail RPA complexes, UI.Vision RPA est équipé pour gérer diverses exigences d'automatisation.

La nature de l'extension de navigateur d'UI.Vision RPA offre commodité et facilité d'utilisation. Il s'intègre de manière transparente dans les navigateurs Web populaires, permettant aux utilisateurs d'exploiter tout le potentiel de l'extension directement dans leur environnement de navigation.

Cela élimine le besoin d'installer des logiciels séparés et fournit une interface conviviale pour créer et gérer des tâches d'automatisation.

8. Poulpe

Octoparse est un outil de scraping Web polyvalent qui s'adresse aux utilisateurs intermédiaires et offre une interface glisser-déposer.

Il prend en charge le scraping local et basé sur le cloud, ce qui le rend flexible pour différents cas d'utilisation. Octoparse peut gérer le CAPTCHA et des mécanismes anti-scraping, essentiels pour les sites Web modernes.

Bien que convivial, la configuration de flux de travail pour les tâches avancées peut s'avérer difficile. La structure tarifaire peut également être coûteuse pour les petits utilisateurs.

9. Phantombuster

PhantomBuster est un outil puissant conçu pour automatiser des tâches telles que l'extraction de données sur les réseaux sociaux, la génération de leads et l'automatisation des flux de travail.

Il propose des modèles prédéfinis pour des plateformes telles que LinkedIn, Twitter et Instagram, ce qui le rend convivial pour les non-codeurs.

L'intégration avec des outils comme Zapier permet aux utilisateurs de connecter PhantomBuster à des flux de travail plus importants. Cependant, il est davantage axé sur les données sociales et moins efficace pour le scraping Web général.

De plus, le prix de l’abonnement peut devenir coûteux pour les projets à grande échelle.

10. WebHarvy

WebHarvy est un scraper Web de bureau de type pointer-cliquer qui ne nécessite aucune compétence en codage.

Il est idéal pour les utilisateurs qui souhaitent extraire rapidement des données de sites Web statiques ou dynamiques sans configurations complexes.

WebHarvy prend en charge des fonctionnalités avancées telles que les modèles d'expressions régulières, le formatage des données et la planification, ce qui le rend polyvalent pour les projets de petite et moyenne taille.

Cependant, il est limité à une utilisation sur ordinateur de bureau et n'offre pas de scraping basé sur le cloud, ce qui peut être un inconvénient pour les projets à grande échelle ou collaboratifs.

Liens rapides:

- Alternatives à Webshare : mes préférées

- Libérer la puissance du robot d'exploration Web

- Meilleurs proxys de grattage Web

- Examen IPRoyal

- Examen du centre de proxy

Conclusion : Les alternatives à Apify 2026

Le choix de la meilleure alternative à Apify dépend de vos besoins, de votre budget et de vos compétences techniques. Si vous êtes un développeur à la recherche d'une personnalisation complète, Scrapy est un excellent framework open source.

Pour les débutants ou les non-codeurs, ParseHub et Octoparse offrent des interfaces conviviales sans programmation requise.

Si vous vous concentrez sur l'automatisation des réseaux sociaux et la génération de leads, PhantomBuster est une excellente option. Pour un scraping rapide et facile sur ordinateur, WebHarvy est idéal.

Chaque outil a ses points forts et ses limites. Évaluez donc la taille, la complexité et le budget de votre projet pour trouver la solution idéale. Il existe une option pour tout le monde, des utilisateurs occasionnels aux développeurs avancés.