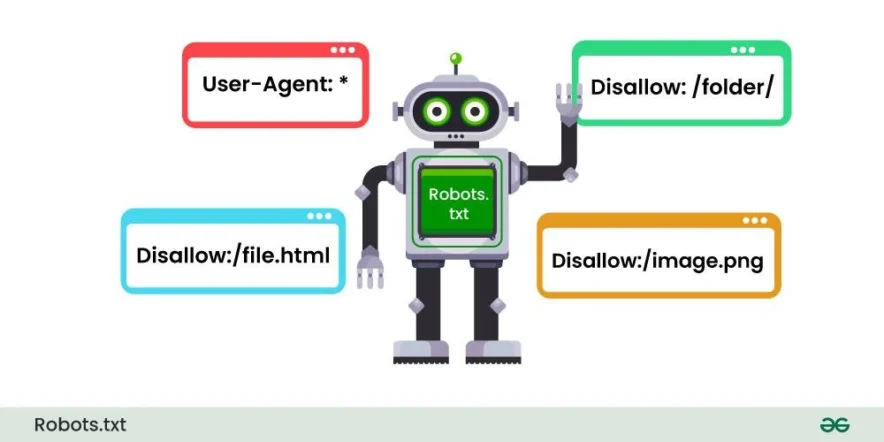

3 октября 2025 года в новом отчёте раскрывается мощь Robots.txt для SEO — небольшого файла, который может как обеспечить, так и погубить успех вашего сайта в поисковой выдаче. Этот текстовый файл, незаметно расположенный по адресу example.com/robots.txt, сообщает поисковым системам, таким как Google, какие страницы сканировать, а какие пропускать. Неверный шаг — и ваши позиции в выдаче могут мгновенно упасть, как это случилось с одним сайтом электронной коммерции, когда ошибка в промежуточном файле обрушила его трафик на 90%. В условиях, когда ИИ-боты и поисковые запросы с нулевым кликом меняют облик интернета, использование Robots.txt для SEO — это не просто разумное решение, это залог выживания. Этот простой инструмент управляет роботом Google, защищает конфиденциальные страницы и повышает эффективность сканирования, но одна неверная строка может скрыть ваш сайт от всего мира.

Robots.txt для SEO: ключевые особенности и подводные камни, которых следует избегать

Файл robots.txt для SEO действует как сторож, направляя поисковые роботы к вашему лучшему контенту и блокируя тупиковые ситуации, такие как дубликаты страниц или промежуточные сайты. Неправильные настройки, такие как ошибки с учётом регистра или блокировка JavaScript, могут помешать Google обрабатывать ваш сайт, что негативно скажется на его рейтинге. Роботы с искусственным интеллектом (ИИ) сеют хаос, игнорируя правила или сканируя платный контент, как это было видно, когда бот OpenAI столкнулся с препятствиями. Учитывая, что 65% поисковых запросов теперь не требуют кликов, а количество запросов с использованием ИИ стремительно растёт, ваш robots.txt формирует видимость в будущем, управляемом ИИ.

Ключевые сведения о robots.txt для SEO включают:

- Контроль сканирования: дает указание Googlebot отдать приоритет страницам с высокой ценностью, экономя ограниченный бюджет сканирования.

- Правила доступа: Блокирует конфиденциальные области, такие как панели администратора или результаты внутреннего поиска.

- Чувствительность к синтаксису: «Disallow: /Admin/» пропускает /admin/ — регистр имеет значение.

- Проблемы ИИ: 13.26% ИИ-ботов игнорируют robots.txt, что на 3.3% больше, чем в прошлом году.

- Задержка кэширования: По словам Джона Мюллера из Google, регистрация изменений занимает 24 часа.

- Миф об индексации: Блокирует сканирование, но не индексацию — страницы по-прежнему могут появляться по внешним ссылкам.

Читайте также: Статистика email-маркетинга: ключевые данные и аналитика

Последние данные показывают, что Google направляет в 831 раз больше посетителей, чем искусственный интеллект, однако трафик от ботов резко растёт: каждое пятидесятое посещение теперь происходит с помощью искусственного интеллекта. Издатели дают отпор: количество блокировок ботов ежегодно увеличивается на 336%. Появляются новые стандарты, такие как llms.txt, для борьбы с ИИ-скрейперами, предлагающие детальный контроль. Такие ошибки, как блокировка критически важных файлов, незаметно снижают трафик — проверьте Google Search Console на наличие ошибок «Индексировано, хотя и заблокировано». Оптимизируйте robots.txt для SEO, чтобы сосредоточить сканирование на ценных страницах, избежать перегрузки ИИ и обеспечить будущее своего сайта. Один файл, бесконечное влияние — протестируйте его сейчас, иначе рискуете исчезнуть из поиска.

Больше новостей для чтения: Статистика посещений Google: в 831 раз больше трафика, чем у ИИ

Hreflang в международном SEO сталкивается со скрытым кризисом