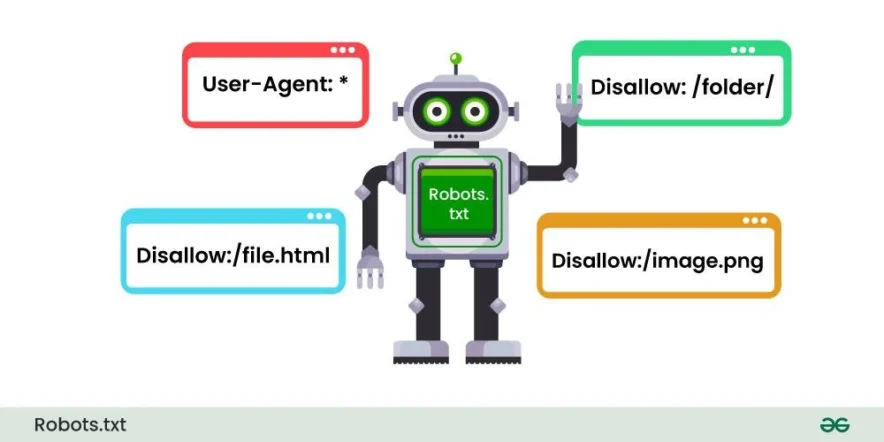

3 жовтня 2025 року в новому звіті розкривається потужність Robots.txt для SEO, крихітного файлу, який може як вплинути на успіх вашого веб-сайту в пошуку, так і зруйнувати його. Цей текстовий файл, тихо розташований за адресою example.com/robots.txt, повідомляє пошуковим системам, таким як Google, які сторінки сканувати, а які пропускати. Якщо ви зробите тут помилку, ваші рейтинги можуть впасти за одну ніч, як дізнався один сайт електронної комерції, коли помилка проміжного файлу скоротила його трафік на 90%. Завдяки ботам штучного інтелекту та пошуку з нульовим кліком, що змінюють Інтернет, оволодіння Robots.txt для SEO — це не просто розумний інструмент, це спосіб виживання. Цей простий інструмент керує Googlebot, захищає конфіденційні сторінки та підвищує ефективність сканування, але один неправильний рядок може приховати ваш сайт від світу.

Robots.txt для SEO: ключові функції та підводні камені, яких слід уникати

Файл robots.txt для SEO діє як «сторож», спрямовуючи пошукові роботи до вашого найкращого контенту, блокуючи при цьому глухі кути, такі як дублікати сторінок або сайти-стаді. Неправильні конфігурації, такі як помилки, що враховують регістр, або блокування JavaScript, можуть паралізувати здатність Google відображати ваш сайт, знижуючи рейтинги. Пошукові роботи зі штучним інтелектом створюють хаос, ігноруючи правила або парсуючи контент з платним доступом, як це було видно, коли бот OpenAI натрапляв на перешкоди. Оскільки 65% пошукових запитів зараз мають нульовий клік, а кількість запитів, заснованих на штучному інтелекті, стрімко зростає, ваш robots.txt формує видимість у майбутньому, керованому штучним інтелектом.

Ключові елементи файлу Robots.txt для SEO-аналітики включають:

- Контроль сканування: Направляє Googlebot на пріоритетність сторінок з високою цінністю, заощаджуючи обмежений бюджет сканування.

- Правила доступуБлокує конфіденційні області, такі як адміністративні панелі або внутрішні результати пошуку.

- Чутливість синтаксу«Заборонити: /Адмін/» пропускає /адмін/ — справа має значення.

- Виклики AI13.26% ботів зі штучним інтелектом ігнорують robots.txt, порівняно з 3.3% минулого року.

- Затримка кешуванняЗа словами Джона Мюллера з Google, реєстрація змін триває 24 години.

- Міф про індексаціюБлокує сканування, а не індексацію — сторінки все ще можуть відображатися через зовнішні посилання.

Також читайте: Статистика email-маркетингу: ключові дані та аналітика

Згідно з останніми даними, Google надсилає у 831 раз більше відвідувачів, ніж штучний інтелект, проте трафік ботів різко зростає, причому 1 з 50 відвідувань тепер зумовлений штучним інтелектом. Видавці чинять опір, а блокування ботів зростає на 336% щорічно. З'являються нові стандарти, такі як llms.txt, для приборкання скреперів ШІ, пропонуючи детальний контроль. Помилки, такі як блокування критично важливих файлів, непомітно руйнують трафік — перевірте Google Search Console на наявність помилок «Індексовано, хоча заблоковано». Оптимізуйте Robots.txt для SEO, щоб зосередити сканування на сторінках грошей, уникнути надмірного використання ШІ та забезпечити майбутнє свого сайту. Один файл, нескінченний вплив — протестуйте його зараз або ризикуєте зникнути з пошуку.

Більше новин для читання: Статистика відвідувачів Google: у 831 разів більше трафіку, ніж від штучного інтелекту