Raschietto Web

- Strumento basato sul browser

- Facile da usare l'interfaccia

- Esporta i dati in CSV/JSON

- Grande per i principianti

ParseHub

- Estrazione visiva dei dati

- Gestisce siti web complessi

- Piattaforma basata su cloud

- Supporta più formati

Scrapy

- Framework basato su Python

- altamente personalizzabile

- Open-source e gratuito

- Ottimo per raschiature su larga scala

Apify è una piattaforma popolare per il web scraping e l'automazione, ma non è una soluzione adatta a tutti.

A seconda dei tuoi obiettivi, che si tratti di estrazione dati, scraping dei social media o automazione su larga scala, potrebbero esserci altri strumenti più adatti alle tue esigenze specifiche, al tuo budget o alle tue competenze tecniche.

Fortunatamente, esistono numerose alternative eccellenti che offrono funzionalità uniche, dalle soluzioni senza codice per principianti ai framework avanzati per sviluppatori.

Esploriamo le migliori alternative ad Apify, analizzandone le caratteristiche, i pro e i contro, così puoi scegliere quella perfetta per il tuo progetto. Immergiamoci!

Le 10 migliori alternative ad Apify 2026: le migliori opzioni da esplorare

Di seguito ho menzionato le 10 migliori alternative ad Apify:

1. Mixnode

Mixnode è una piattaforma dinamica progettata per estrarre e analizzare dati da Internet con velocità, flessibilità e scalabilità straordinarie.

Offre un'ampia gamma di funzionalità che consentono un'estrazione efficiente dei dati e un'analisi completa da diverse fonti online.

Nel suo nucleo, Mixnode eccelle nella sua capacità di recuperare rapidamente i dati dal webGrazie alla sua infrastruttura ad alte prestazioni, questa piattaforma garantisce una rapida estrazione delle informazioni desiderate, riducendo al minimo il tempo e lo sforzo necessari per l'acquisizione dei dati.

Sia che tu abbia bisogno di punti dati specifici o set di dati completi, l'agilità di Mixnode garantisce un processo di recupero dei dati continuo ed efficiente.

La flessibilità è un altro punto di forza di Mixnode. Offre un toolkit versatile che consente agli utenti di personalizzare le proprie esigenze di estrazione dei dati in base alle proprie esigenze specifiche.

Dai dati strutturati ai contenuti non strutturati, Mixnode fornisce gli strumenti necessari per estrarre e trasformare le informazioni da varie fonti web, consentendo agli utenti di ottenere preziose informazioni e prendere decisioni basate sui dati.

2. Raschietto Web

Web Scraper è molto acclamato estensione di web scraping, ampiamente riconosciuto come lo strumento più popolare nel suo genere.

Con Web Scraper, puoi avviare attività di scraping in pochi minuti, grazie alla sua interfaccia intuitiva e al processo di configurazione senza interruzioni.

Inoltre, la funzione Cloud Scraper consente l'automazione delle attività, eliminando la necessità di download di software o competenze di codifica.

Come scelta ideale per il web scraping, Web Scraper offre una serie di vantaggi per gli utenti che cercano di estrarre dati preziosi dai siti web.

La sua popolarità deriva dalla sua semplicità e accessibilità. Che tu sia un principiante o un utente esperto, l'interfaccia intuitiva di Web Scraper ti consente di iniziare rapidamente con le tue attività di scraping.

Non è necessario dedicare tempo e sforzi preziosi alla navigazione di software complessi o alla decifrazione di complessi linguaggi di codifica.

La caratteristica chiave di Web Scraper, Cloud Scraper, porta l'automazione a un livello superiore. Sfruttando questa potente funzionalità, puoi semplificare e accelerare le tue attività di scraping.

Con Cloud Scraper, non è necessario installare alcun software sul dispositivo, liberando spazio di archiviazione prezioso. Inoltre, puoi dire addio alle complessità della codifica.

Web Scraper elimina il requisito della codifica manuale, consentendo agli utenti di automatizzare le attività senza alcuna competenza tecnica.

3. Import.io

Import.io è una piattaforma web all'avanguardia che offre agli utenti la possibilità di sfruttare la potenza dei dati web leggibili dalla macchina.

Grazie alla suite completa di strumenti di Import.io, puoi creare API o analizzare interi siti web senza sforzo, con una velocità ed efficienza senza pari, il tutto senza bisogno di scrivere codice.

Fondamentalmente, Import.io rivoluziona il modo in cui gli utenti interagiscono con i dati web. I metodi tradizionali di estrazione e analisi dei dati spesso comportano lunghi processi manuali e codifica complessa.

Tuttavia, Import.io semplifica l'intero flusso di lavoro, consentendo agli utenti di estrarre e utilizzare dati preziosi dal Web in una frazione del tempo.

Una delle caratteristiche distintive di Import.io è la sua capacità di creare API senza codifica. Le API, o interfacce di programmazione dell'applicazione, sono fondamentali per consentire l'integrazione e l'automazione dei dati senza soluzione di continuità.

Con Import.io, puoi trasformare facilmente i dati Web in API, consentendo uno scambio di dati fluido ed efficiente tra diversi sistemi e applicazioni.

Questo apre un mondo di possibilità per sviluppatori, data scientist e aziende che cercano di sfruttare i dati Web per le loro esigenze specifiche.

4. UiPath

UiPath è un potente strumento di automazione che offre un set completo di funzionalità per automatizzare le applicazioni web e desktop.

Fornisce una piattaforma gratuita, completa di funzionalità e altamente estensibile, rendendola la scelta ideale per individui, piccoli team di professionisti, istituti scolastici e scopi di formazione.

In sostanza, UiPath consente agli utenti di automatizzare varie attività e processi, aumentando la produttività ed efficienza.

Che si tratti di automatizzare azioni ripetitive in un'applicazione Web o di semplificare i flussi di lavoro in un ambiente desktop, le versatili funzionalità di UiPath soddisfano un'ampia gamma di esigenze di automazione.

Uno dei principali vantaggi di UiPath è la sua interfaccia user-friendly, che semplifica il processo di automazione. La piattaforma fornisce un designer di workflow visivo, che consente agli utenti di creare flussi di lavoro di automazione senza la necessità di conoscenze approfondite di codifica.

Attraverso un approccio drag-and-drop, gli utenti possono facilmente assemblare sequenze di automazione combinando attività come l'estrazione dei dati, l'automazione dell'input e la logica decisionale.

5. ParseHub

ParseHub è un potente strumento di web scraping progettato specificamente per navigare ed estrarre dati dal panorama web moderno. Una delle caratteristiche distintive di ParseHub è la sua capacità di estrarre dati praticamente da qualsiasi punto del web.

Sia che tu abbia a che fare con applicazioni a pagina singola, applicazioni multipagina o qualsiasi altra moderna tecnologia web, ParseHub è attrezzato per gestire la sfida.

Naviga senza sforzo attraverso pagine Web dinamiche, siti basati su AJAX e altre tecnologie Web avanzate, assicurando che nessun dato rimanga fuori portata.

Gli elementi di ParseHub sono comunemente usati nello sviluppo web moderno per migliorare l'esperienza dell'utente e caricare dinamicamente i contenuti.

Tuttavia, possono rappresentare una sfida per i tradizionali strumenti di raschiatura. Gli algoritmi avanzati e la solida infrastruttura di ParseHub gestiscono senza problemi queste complessità, garantendo un'estrazione dei dati accurata e completa.

ParseHub fornisce un'interfaccia intuitiva e un sistema visivo point-and-click per la creazione di progetti di scraping. Puoi facilmente definire i dati di cui hai bisogno selezionando gli elementi sulla pagina web, come testo, immagini, link o tabelle.

Questo approccio intuitivo elimina la necessità di una codifica complessa o di una navigazione manuale attraverso le strutture HTML. Con ParseHub, puoi creare e modificare rapidamente progetti di scraping, risparmiando tempo e fatica preziosi.

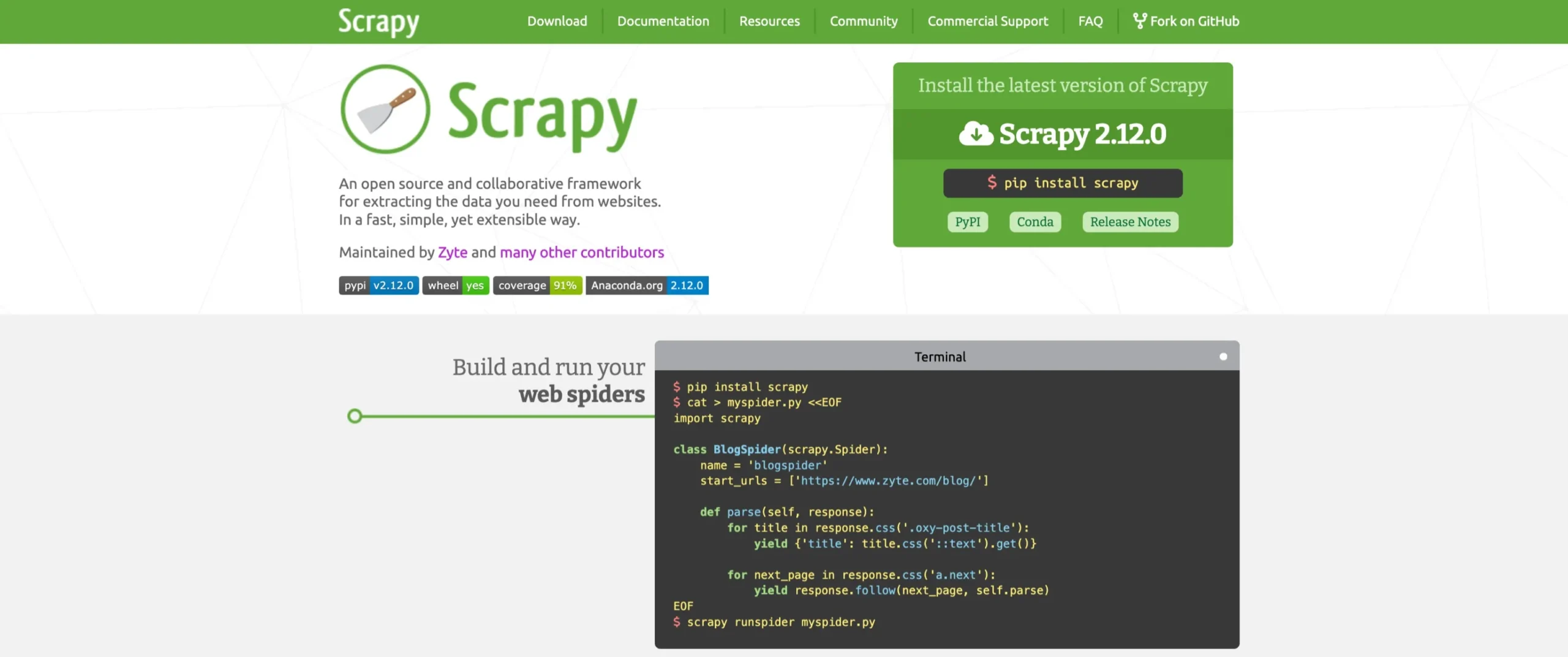

6. Scrapy

Scrapy è un framework di scansione web basato su Python rinomato per la sua versatilità e natura open source.

Originariamente progettato per il web scraping, Scrapy si è evoluto fino a diventare un potente strumento per l'estrazione di dati utilizzando le API e funzionando come un web crawler generico.

Sviluppato e gestito da Zyte, precedentemente noto come Scrapinghub, Scrapy è ampiamente considerato affidabile nel campo del web scraping.

Fondamentalmente, Scrapy fornisce un set completo di strumenti e librerie per il web crawling e l'estrazione dei dati. Offre un'architettura flessibile e modulare che consente agli sviluppatori di adattare i propri progetti di scraping a requisiti specifici.

Con la sua base Python, Scrapy sfrutta il ricco ecosistema e le ampie librerie disponibili nel linguaggio di programmazione Python, rendendolo una scelta popolare tra gli sviluppatori.

La versatilità di Scrapy va oltre il web scraping. Il framework si integra perfettamente con le API, consentendo agli utenti di estrarre dati da un'ampia gamma di fonti.

Sfruttando le API, Scrapy può recuperare dati strutturati da Social Media piattaforme, servizi web e vari database online.

Questa flessibilità rende Scrapy la scelta ideale per applicazioni che vanno oltre il tradizionale web scraping.

7. UI.Visione RPA

UI.Vision RPA è uno strumento open source per l'automazione di attività e test che va oltre le capacità tradizionali. Come estensione del browser, non solo abilita automazione web ma offre anche funzionalità di automazione desktop.

Uno dei principali vantaggi di UI.Vision RPA è la sua versatilità. Gli strumenti di automazione tradizionali spesso si concentrano esclusivamente sull'automazione web, tralasciando altri aspetti dell'automazione delle attività.

Tuttavia, UI.Vision RPA rompe questa barriera fornendo la possibilità di automatizzare le attività sia sul Web che sul desktop.

Che si tratti di interagire con applicazioni Web, automatizzare l'invio di moduli, estrarre dati da schermate o eseguire complessi flussi di lavoro RPA, UI.Vision RPA è in grado di gestire diversi requisiti di automazione.

La natura dell'estensione del browser di UI.Vision RPA offre praticità e facilità d'uso. Si integra perfettamente nei browser Web più diffusi, consentendo agli utenti di sfruttare tutto il potenziale dell'estensione direttamente all'interno del loro ambiente di navigazione.

Ciò elimina la necessità di installazioni software separate e fornisce un'interfaccia intuitiva per la creazione e la gestione delle attività di automazione.

8. Octoparse

Octoparse è uno strumento versatile di web scraping pensato per utenti intermedi e dotato di un'interfaccia drag-and-drop.

Supporta sia lo scraping locale che quello basato sul cloud, il che lo rende flessibile per diversi casi d'uso. Octoparse può gestire CAPTCHA e meccanismi anti-scraping, essenziali per i siti web moderni.

Sebbene sia user-friendly, impostare flussi di lavoro per attività avanzate può essere impegnativo. Anche la struttura dei prezzi può essere costosa per gli utenti su piccola scala.

9. PhantomBuster

PhantomBuster è un potente strumento progettato per automatizzare attività come l'estrazione di dati dai social media, la generazione di lead e l'automazione dei flussi di lavoro.

Offre modelli predefiniti per piattaforme come LinkedIn, Twitter e Instagram, rendendolo facile da usare anche per chi non è un programmatore.

L'integrazione con strumenti come Zapier consente agli utenti di collegare PhantomBuster a flussi di lavoro più ampi. Tuttavia, è più focalizzato sui dati social e meno efficace per il web scraping generale.

Inoltre, il prezzo dell'abbonamento può risultare costoso per i progetti in espansione.

10 WebHarvy

WebHarvy è uno scraper web desktop di tipo point-and-click che non richiede competenze di programmazione.

È ideale per gli utenti che desiderano estrarre rapidamente dati da siti Web statici o dinamici senza configurazioni complesse.

WebHarvy supporta funzionalità avanzate come modelli regex, formattazione dei dati e pianificazione, rendendolo versatile per progetti di piccole e medie dimensioni.

Tuttavia, è limitato all'uso desktop e non offre lo scraping basato su cloud, il che può rappresentare uno svantaggio per progetti collaborativi o su larga scala.

Link veloci:

- Alternative a Webshare: le mie preferite

- Liberare la potenza del web crawler

- I migliori proxy per il web scraping

- IPRecensione reale

- Revisione hub proxy

Conclusione: le alternative ad Apify 2026

La scelta della migliore alternativa ad Apify dipende dalle tue esigenze, dal tuo budget e dalle tue competenze tecniche. Se sei uno sviluppatore che cerca una personalizzazione completa, Scrapy è un eccellente framework open source.

Per i principianti o i non programmatori, ParseHub e Octoparse offrono interfacce intuitive che non richiedono alcuna programmazione.

Se il tuo focus è l'automazione dei social media e la generazione di lead, PhantomBuster è un'ottima opzione. Per uno scraping rapido e semplice basato su desktop, WebHarvy è l'ideale.

Ogni strumento ha i suoi punti di forza e limiti, quindi valuta le dimensioni del tuo progetto, la complessità e il budget per trovare la soluzione perfetta. C'è un'opzione per tutti, dagli utenti occasionali agli sviluppatori avanzati.