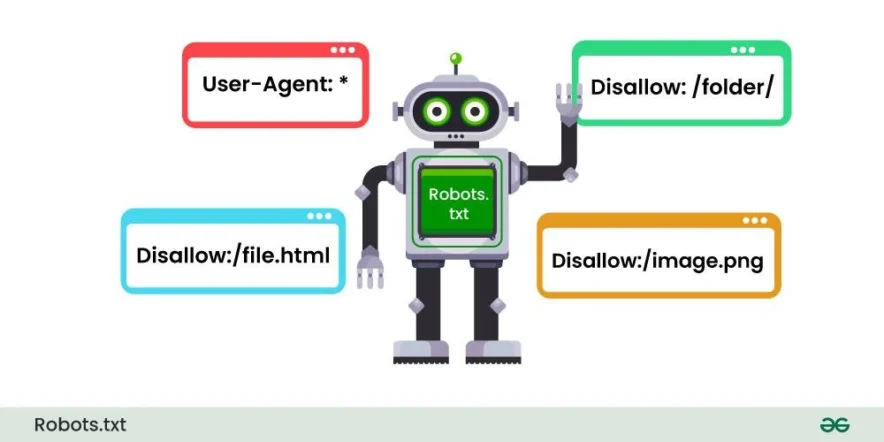

Em 3 de outubro de 2025, um novo relatório revela o poder do Robots.txt para SEO, um pequeno arquivo que pode determinar o sucesso ou o fracasso do seu site nas buscas. Localizado discretamente em example.com/robots.txt, este arquivo de texto informa a mecanismos de busca como o Google quais páginas rastrear — ou ignorar. Um erro aqui pode fazer com que sua classificação caia da noite para o dia, como um site de comércio eletrônico descobriu quando um erro no arquivo de preparação reduziu seu tráfego em 90%. Com bots de IA e buscas sem cliques remodelando a web, dominar o Robots.txt para SEO não é apenas uma questão de inteligência — é sobrevivência. Esta ferramenta simples controla o Googlebot, protege páginas sensíveis e aumenta a eficiência do rastreamento, mas uma linha errada pode ocultar seu site do mundo.

Robots.txt para SEO: Principais recursos e armadilhas a evitar

O Robots.txt para SEO atua como um guardião, guiando os rastreadores para o seu melhor conteúdo, enquanto bloqueia becos sem saída, como páginas duplicadas ou sites de teste. Configurações incorretas, como erros de diferenciação de maiúsculas e minúsculas ou bloqueio de JavaScript, podem prejudicar a capacidade do Google de renderizar seu site, prejudicando os rankings. Os rastreadores de IA adicionam caos, ignorando regras ou raspando conteúdo com acesso pago, como visto quando o bot da OpenAI encontrou obstáculos. Com 65% das pesquisas agora sem clique e as consultas de IA aumentando, seu robots.txt molda a visibilidade em um futuro impulsionado pela IA.

Os principais insights de SEO do Robots.txt incluem:

- Controle de rastreamento: Instrui o Googlebot a priorizar páginas de alto valor, economizando um orçamento de rastreamento finito.

- Regras de acesso: Bloqueia áreas sensíveis, como painéis de administração ou resultados de pesquisa interna.

- Sensibilidade de sintaxe: “Disallow: /Admin/” ignora /admin/ — o caso importa.

- Desafios de IA: 13.26% dos bots de IA ignoram o robots.txt, um aumento de 3.3% em relação ao ano passado.

- Atraso no cache: As alterações levam 24 horas para serem registradas, segundo John Mueller, do Google.

- Mito da Indexação: Bloqueia o rastreamento, não a indexação — as páginas ainda podem aparecer por meio de links externos.

Leia também: Estatísticas de marketing por e-mail: dados e insights importantes

Dados recentes mostram que o Google envia 831 vezes mais visitantes do que a IA, mas o tráfego de bots dispara, com 1 em cada 50 visitas agora sendo impulsionado pela IA. Os editores reagem, com o bloqueio de bots aumentando 336% ao ano. Novos padrões como o llms.txt surgem para domar os scrapers de IA, oferecendo controle granular. Erros, como o bloqueio de arquivos críticos, corroem o tráfego silenciosamente — verifique o Google Search Console para erros "Indexado, embora bloqueado". Otimize o Robots.txt para SEO para concentrar os rastreamentos em páginas de dinheiro, evitar o alcance excessivo da IA e preparar seu site para o futuro. Um arquivo, impacto infinito — teste agora ou corra o risco de desaparecer das buscas.

Mais notícias para ler: Estatísticas de visitantes do Google: 831x mais tráfego do que a IA