Веб скребок

- Инструмент на основе браузера

- Простой в использовании интерфейс

- Экспортирует данные в CSV/JSON

- Отлично подходит для начинающих

ParseHub

- Визуальное извлечение данных

- Обрабатывает сложные веб-сайты

- Облачная платформа

- Поддерживает несколько форматов

Scrapy

- Фреймворк на основе Python

- Высоко настраиваемый

- С открытым исходным кодом и бесплатно

- Отлично подходит для крупномасштабной очистки.

Apify — популярная платформа для веб-скрапинга и автоматизации, но она не является универсальным решением.

В зависимости от ваших целей — будь то извлечение данных, анализ социальных сетей или масштабная автоматизация — могут быть другие инструменты, которые лучше соответствуют вашим конкретным потребностям, бюджету или техническим навыкам.

К счастью, существует множество отличных альтернатив, предлагающих уникальные возможности: от вариантов без кода для новичков до продвинутых фреймворков для разработчиков.

Давайте рассмотрим лучшие альтернативы Apify, разберем их особенности, плюсы и минусы, чтобы вы могли выбрать тот, который идеально подойдет для вашего проекта. Давайте погрузимся!

10 лучших альтернатив Apify 2026: лучшие варианты для изучения

Ниже я перечислил 10 лучших альтернатив Apify:

1. Микснода

Mixnode — это динамическая платформа, предназначенная для извлечения и анализа данных из Интернета с впечатляющей скоростью, гибкостью и высокой масштабируемостью.

Он предлагает широкий спектр возможностей, которые обеспечивают эффективное извлечение данных и комплексный анализ из различных онлайн-источников.

По своей сути Mixnode выделяется своей способностью быстро извлекать данные из Интернета. Благодаря высокопроизводительной инфраструктуре эта платформа обеспечивает быстрое извлечение нужной информации, сводя к минимуму время и усилия, необходимые для получения данных.

Нужны ли вам конкретные точки данных или полные наборы данных, гибкость Mixnode обеспечивает бесперебойный и эффективный процесс поиска данных.

Гибкость — еще одна сильная сторона Mixnode. Он предлагает универсальный набор инструментов, который позволяет пользователям адаптировать свои потребности в извлечении данных в соответствии со своими конкретными требованиями.

От структурированных данных до неструктурированного контента, Mixnode предоставляет необходимые инструменты для извлечения и преобразования информации из различных веб-источников, позволяя пользователям получать ценную информацию и принимать решения на основе данных.

2. Веб скребок

Web Scraper — высоко оцененный расширение веб-скрейпинга, широко признанный самым популярным инструментом в своем роде.

С помощью Web Scraper вы можете начать парсинг в течение нескольких минут благодаря удобному интерфейсу и простому процессу настройки.

Кроме того, функция Cloud Scraper позволяет автоматизировать задачи, устраняя необходимость в загрузке программного обеспечения или опыте кодирования.

Web Scraper — лучший выбор для парсинга веб-страниц. Он предлагает множество преимуществ для пользователей, стремящихся извлечь ценные данные с веб-сайтов.

Его популярность обусловлена простотой и доступностью. Независимо от того, являетесь ли вы новичком или опытным пользователем, интуитивно понятный интерфейс Web Scraper позволит вам быстро приступить к парсингу.

Вам не нужно тратить драгоценное время и усилия на работу со сложным программным обеспечением или на расшифровку сложных языков кодирования.

Ключевая функция Web Scraper, Cloud Scraper, выводит автоматизацию на новый уровень. Используя эту мощную функциональность, вы можете упростить и ускорить выполнение задач парсинга.

С Cloud Scraper вам не нужно устанавливать какое-либо программное обеспечение на ваше устройство, освобождая ценное место для хранения. Более того, вы можете попрощаться с тонкостями кодирования.

Web Scraper устраняет необходимость ручного кодирования, позволяя пользователям автоматизировать задачи без каких-либо технических знаний.

3. Импорт.ио

Import.io — это передовая веб-платформа, которая дает пользователям возможность использовать всю мощь машиночитаемых веб-данных.

С помощью комплексного набора инструментов Import.io вы можете легко создавать API или сканировать целые веб-сайты с непревзойденной скоростью и эффективностью, и все это без необходимости кодирования.

По своей сути Import.io революционизирует способ взаимодействия пользователей с веб-данными. Традиционные методы извлечения и анализа данных часто включают трудоемкие ручные процессы и сложное кодирование.

Однако Import.io оптимизирует весь этот рабочий процесс, позволяя пользователям извлекать и использовать ценные данные из Интернета за короткое время.

Одной из выдающихся особенностей Import.io является возможность создавать API без программирования. API-интерфейсы или интерфейсы прикладного программирования играют важную роль в обеспечении беспрепятственной интеграции и автоматизации данных.

С помощью Import.io вы можете легко преобразовывать веб-данные в API, обеспечивая плавный и эффективный обмен данными между различными системами и приложениями.

Это открывает мир возможностей для разработчиков, специалистов по данным и предприятий, стремящихся использовать веб-данные для своих конкретных нужд.

4. UiPath

UiPath — это мощный инструмент автоматизации, предлагающий полный набор функций для автоматизации веб-приложений и настольных приложений.

Это бесплатная, полнофункциональная и расширяемая платформа, что делает ее идеальным выбором для отдельных лиц, небольших профессиональных групп, образовательных учреждений и учебных целей.

По своей сути UiPath позволяет пользователям автоматизировать различные задачи и процессы, повышение производительности и эффективности.

Будь то автоматизация повторяющихся действий в веб-приложении или оптимизация рабочих процессов в настольной среде, универсальные возможности UiPath удовлетворяют широкий спектр потребностей в автоматизации.

Одним из ключевых преимуществ UiPath является удобный интерфейс, который упрощает процесс автоматизации. Платформа предоставляет визуальный конструктор рабочих процессов, позволяющий пользователям создавать автоматизированные рабочие процессы без необходимости обширных знаний в области кодирования.

Благодаря методу перетаскивания пользователи могут легко собирать последовательности автоматизации, комбинируя действия, такие как извлечение данных, автоматизация ввода и логика принятия решений.

5. ParseHub

ParseHub — это мощный инструмент веб-скрейпинга, разработанный специально для навигации и извлечения данных из современного веб-ландшафта. Одной из выдающихся особенностей ParseHub является его способность извлекать данные практически из любого места в Интернете.

Независимо от того, имеете ли вы дело с одностраничными приложениями, многостраничными приложениями или любой другой современной веб-технологией, ParseHub готов справиться с этой задачей.

Он легко перемещается по динамическим веб-страницам, сайтам на основе AJAX и другим передовым веб-технологиям, гарантируя, что никакие данные не останутся вне досягаемости.

Элементы ParseHub обычно используются в современной веб-разработке для улучшения взаимодействия с пользователем и динамической загрузки контента.

Однако они могут создавать проблемы для традиционных инструментов очистки. Передовые алгоритмы и надежная инфраструктура ParseHub легко справляются с этими сложностями, обеспечивая точное и всестороннее извлечение данных.

ParseHub предоставляет удобный интерфейс и визуальную систему «укажи и щелкни» для создания парсинг-проектов. Вы можете легко определить необходимые данные, выбрав элементы на веб-странице, такие как текст, изображения, ссылки или таблицы.

Этот интуитивно понятный подход устраняет необходимость в сложном программировании или ручной навигации по структурам HTML. С ParseHub вы можете быстро создавать и изменять парсинг-проекты, экономя драгоценное время и силы.

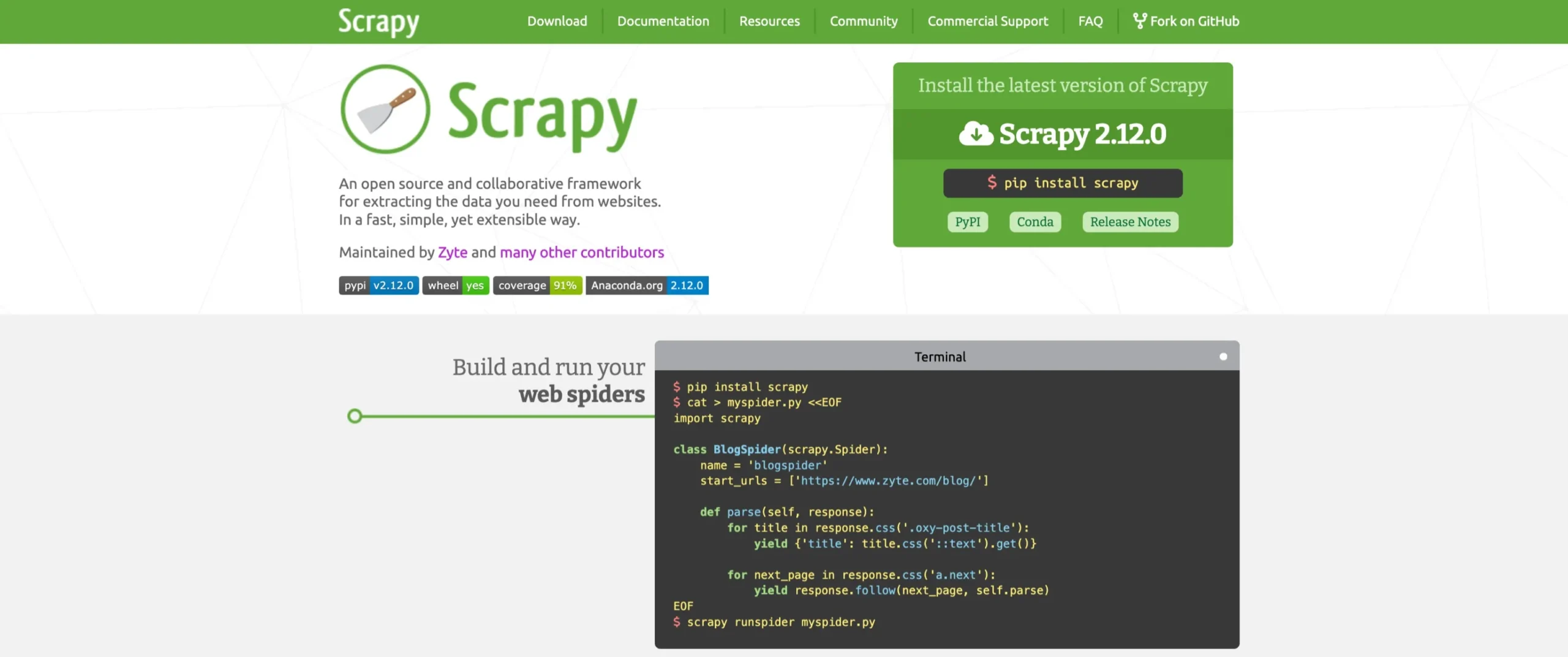

6. Scrapy

Scrapy — это фреймворк для веб-сканирования на основе Python, известный своей универсальностью и открытым исходным кодом.

Первоначально разработанный для парсинга веб-страниц, Scrapy превратился в мощный инструмент для извлечения данных с использованием API-интерфейсов и работает как веб-краулер общего назначения.

Разработанный и поддерживаемый Zyte, ранее известный как Scrapinghub, Scrapy широко пользуется доверием в области парсинга веб-страниц.

По своей сути Scrapy предоставляет полный набор инструментов и библиотек для веб-сканирования и извлечения данных. Он предлагает гибкую и модульную архитектуру, которая позволяет разработчикам адаптировать свои проекты парсинга к конкретным требованиям.

Основанный на Python, Scrapy использует богатую экосистему и обширные библиотеки, доступные на языке программирования Python, что делает его популярным выбором среди разработчиков.

Универсальность Scrapy выходит за рамки веб-скрапинга. Платформа легко интегрируется с API, позволяя пользователям извлекать данные из самых разных источников.

Используя API, Scrapy может извлекать структурированные данные из социальные сети платформы, веб-сервисы и различные онлайн-базы данных.

Благодаря своей гибкости Scrapy является идеальным выбором для приложений, выходящих за рамки традиционного веб-скрапинга.

7. UI.Vision RPA

UI.Vision RPA — это инструмент автоматизации задач и тестирования с открытым исходным кодом, который выходит за рамки традиционных возможностей. Как расширение браузера, он не только позволяет веб-автоматизация но также предлагает функции автоматизации рабочего стола.

Одно из ключевых преимуществ UI.Vision RPA — его универсальность. Традиционные инструменты автоматизации часто фокусируются исключительно на веб-автоматизации, оставляя другие аспекты автоматизации задач без внимания.

Однако UI.Vision RPA преодолевает этот барьер, предоставляя возможность автоматизировать задачи как в Интернете, так и на рабочем столе.

Будь то взаимодействие с веб-приложениями, автоматизация отправки форм, извлечение данных с экранов или выполнение сложных рабочих процессов RPA, UI.Vision RPA способен удовлетворить разнообразные требования автоматизации.

Браузерное расширение UI.Vision RPA обеспечивает удобство и простоту использования. Он легко интегрируется в популярные веб-браузеры, позволяя пользователям использовать весь потенциал расширения непосредственно в своей среде просмотра.

Это устраняет необходимость в отдельной установке программного обеспечения и обеспечивает удобный интерфейс для создания задач автоматизации и управления ими.

8. Осьминога

Octoparse — это универсальный инструмент для веб-скрапинга, рассчитанный на пользователей среднего уровня и предлагающий интерфейс с функцией перетаскивания.

Он поддерживает как локальный, так и облачный сбор данных, что делает его гибким для различных вариантов использования. Octoparse может обрабатывать CAPTCHA и механизмы защиты от взлома, что крайне важно для современных веб-сайтов.

Хотя это удобно для пользователя, настройка рабочих процессов для сложных задач может быть сложной. Структура ценообразования также может быть дорогой для небольших пользователей.

9. Фантомбастер

PhantomBuster — мощный инструмент, предназначенный для автоматизации таких задач, как извлечение данных из социальных сетей, генерация лидов и автоматизация рабочих процессов.

Он предлагает готовые шаблоны для таких платформ, как LinkedIn, Twitter и Instagram, что делает его удобным для пользователей, не являющихся программистами.

Интеграция с такими инструментами, как Zapier, позволяет пользователям подключать PhantomBuster к более крупным рабочим процессам. Однако он больше ориентирован на социальные данные и менее эффективен для общего веб-скрапинга.

Кроме того, стоимость подписки может оказаться слишком высокой для масштабируемых проектов.

10. ВебХарви

WebHarvy — это веб-скрапер для настольного компьютера, работающий по принципу «укажи и щелкни», не требующий навыков программирования.

Он идеально подходит для пользователей, которым необходимо быстро извлекать данные со статических или динамических веб-сайтов без сложных настроек.

WebHarvy поддерживает расширенные функции, такие как шаблоны регулярных выражений, форматирование данных и планирование, что делает его универсальным для небольших и средних проектов.

Однако он ограничен использованием на настольном компьютере и не предлагает возможности облачного парсинга, что может стать недостатком для крупномасштабных или совместных проектов.

Быстрые ссылки:

- Альтернативы Webshare: мои самые любимые

- Раскрытие возможностей веб-краулера

- Лучшие прокси-серверы для парсинга веб-страниц

- Обзор IPRoyal

- Обзор Proxy Hub

Заключение: Альтернативы Apify 2026

Выбор лучшей альтернативы Apify зависит от ваших потребностей, бюджета и технических навыков. Если вы разработчик, ищущий полную настройку, Scrapy — это отличный фреймворк с открытым исходным кодом.

Для новичков и неспециалистов по программированию ParseHub и Octoparse предлагают удобные интерфейсы, не требующие программирования.

Если вы сосредоточены на автоматизации социальных сетей и генерации лидов, PhantomBuster — отличный вариант. Для быстрого и легкого парсинга на десктопе WebHarvy — идеальный вариант.

Каждый инструмент имеет свои сильные и слабые стороны, поэтому оцените размер проекта, его сложность и бюджет, чтобы найти идеальное соответствие. Для каждого найдется вариант: от обычных пользователей до продвинутых разработчиков.